Einführung in die Fotografie/ Druckversion

Einführung

[Bearbeiten]Auftakt

[Bearbeiten]Die Geschichte der modernen Photographie (eingedeutsch auch oft: 'Fotografie') ist nunmehr fast 200 Jahre alt, und seit ebenso langer Zeit begeistert sie die Menschen weltweit. Sie ist, physikalisch gesehen, ein recht einfaches Verfahren, dessen Grundzüge bereits im ausgehenden Mittelalter bekannt waren; und dennoch lässt sich ihre Bedeutung heute nicht mehr verleugnen. Wie keine andere Methode ermöglicht sie es jedem, einzelne Augenblicke dauerhaft festzuhalten und einen Blick in die Vergangenheit zu offenbaren. Sie kann beeindrucken, Interesse wecken und empören. Sie hat mal stark künstlerischen und mal nüchternen dokumentarischen Charakter. Sie ist für manche Menschen von hohem persönlichen Wert und für andere völlig uninteressant. Nach ihrer Entstehung hat sie es in kurzer Zeit geschafft, fast alle Bereiche des menschlichen Lebens zu erobern und erlebt insbesondere seit der Jahrtausendwende mit der Digitalphotographie eine bemerkenswerte Renaissance.

Kaum eine Kunst hat heute einen solch hohen Einfluss wie die Photographie und der mit ihr verwandte Film. In unserer Gesellschaft werden wir kaum jemanden finden, der keine Kamera besitzt, sei es als Digitalkamera, ein Mobiltelephon oder ein tragbarer Rechner (englisch: notebook) mit eingebauter Kamera oder ähnliches. Es wird in unserem technisch ausgerichteten Kulturkreis auch kaum jemanden geben, der noch nie in seinem Leben Photos aufgenommen hat, kaum jemanden, der nicht hin und wieder einmal Photos aufnimmt, und auch kaum jemandem, der selbst keine Photos besitzt. Gerade mit der Digitalkamera entstand ein Aufschwung in der Photographie, der sich noch wenige Jahre zuvor kaum erahnen ließ. Waren die Aufnahmen von Laien im letzten Jahrtausend praktisch nur eingeschränkt und privat zugänglich, hat sich nach dem Aufkommen des digitalen internationalen Netzwerkes (kurz Netz; englisch: internet) zusammen mit den Digitalkameras die Szene komplett gewandelt - jeder kann problemlos Aufnahmen machen und sie im Bedarfsfalle ohne nennenswerte Verzögerung im Netz veröffentlichen.

Auf den privaten Rechnern lagern heute oft tausende Urlaubs-, Familien- und Alltagsbilder, Photo-Gemeinschaften im Netz bieten gar Vorräte mit mehreren Milliarden Photos. Netz-Tagebücher (englisch: blogs), Projekte im Netz, Nachrichtenseiten, Prospekte, Werbung, Produktkataloge und Werbeblätter – sie alle werden meist durch reichhaltiges Bildmaterial ergänzt, von dem wiederum ein großer Teil Photographien sind.

Trotz der offensichtlich weitreichenden Bedeutung und Verbreitung der Photographie, die bewusst oder unbewusst Bestandteil unseres alltäglichen Lebens geworden ist, entsteht gelegentlich insbesondere in der heutigen Zeit der Eindruck, dass erstaunlich wenig Menschen grundlegende Kenntnisse über die technischen und gestalterischen Grundlagen der Photographie besitzen. Der erste Aspekt ist im Grunde nicht ungewöhnlich – man kann ein Auto fahren, ohne zu wissen, wie der Motor funktioniert oder welche internen Prozesse dabei stattfinden. Man kann ein Computerprogramm bedienen, ohne sonstige Computerkenntnisse zu haben, und viele Menschen lesen Belletristik, ohne über größere Literaturkenntnisse zu verfügen. All das klappt indessen nur, weil all diese Bereiche stark automatisiert sind: Die für unkundige Laien geeigneten Kameras erledigen fast alles automatisch. Es gibt sogar welche, die bereits das Motiv aussuchen oder auf Vorrat Bilder machen, aus denen der Nutzer dann nur noch auswählen muss. Auch Automobile sind mittlerweile hochautomatisiert, Pannen, bei denen man selbst reparieren könnte, sind kaum noch zu erwarten, auch Computer baut heute der normale Anwender nicht mehr selbst (zusammen), sondern kauft sie komplett funktionsfähig, meist gar gleich mit einem Betriebssystem. In den Anfängen dieser Technologien war das anders - da gab es keine Automatisierung, keine Computer und Programme, die einem alle Arbeit und Intelligenzleistung abgenommen hätten.

In der Tat kann man heute in vielen Situationen zu Photos gelangen, ohne die technischen Grundlagen der Kamera zu beherrschen – die Kameraautomatik kann erstaunlich Vieles. Insbesondere kann eine vollautomatische Kamera spielend in kürzester Zeit viele Parameter gleichzeitig überwachen und einstellen, was dem Menschen zumeist schwerfällt. Möchte man aber mit Photographie mehr anfangen als der Alltagsnutzer, so wird man bald feststellen, dass man an manchen Stellen ohne die Grundlagen nicht mehr auskommt, insbesondere in speziellen Situationen wie beim Photographieren bestimmter Motive, zum Beispiel Makroaufnahmen, Photographieren während der Dämmerung, Darstellen von Bewegung etc. Der Automatikmodus der Kamera wird hier schnell an seine Grenzen stoßen und ein manuelles Einschreiten ist unvermeidlich – spätestens dann sollte man die Grundlagen über Belichtung, Fokussierung und Weißabgleich verstehen. Dies liegt unter anderem auch daran, dass Computerprogramme bislang allenfalls rudimentär das Motiv selbst erkennen können und der Nutzer seine Intentionen auch nur über recht einfache Programmvariationen der Kamera zu vermitteln versuchen kann - diese grobe Motivvorwahl verbessert zwar das 'normale' automatische Resultat in vielen Fällen, kann aber natürlich nicht individuell auf das jeweilige Motiv und Problem eingehen.

Was besagt eigentlich der ISO-Wert? Wie hängen Blende und Belichtungszeit zusammen? Warum verwackeln Photos manchmal oder werden unscharf? Was ist eigentlich die Brennweite und welchen Einfluss hat sie auf das Photo? Wie hängen die Größen der Strukturen des Bildsensors, die Abbildungsqualität des Objektivs, Beugung und die Auflösung des Bildresulates zusammen? Das sind Standardfragen, die jeder ambitionierte Hobby-Photograph beantworten können sollte, und sie werden in diesem Buch in ausführlicher Weise beantwortet.

Der zweite Aspekt, die Bildgestaltung, ist von noch größerer Bedeutung als der erste; wie gut die Kamerautomatik auch sein mag, die Gestaltung eines Photos muss der Photograph stets selbst vornehmen. Hier wird ihm niemand die Arbeit abnehmen, und erst hier entscheidet sich, ob das Photo ein einfacher Schnappschuss oder ein interessantes Kunstwerk wird. Wo sollte das Motiv platziert werden (und was ist eigentlich das Motiv)? Aus welcher Perspektive sollte es photographiert werden? Welche Perspektiven gibt es überhaupt? Welche Arten von Licht gibt es, wie wirkt sich das Licht auf das Bild aus? Welche Rollen spielen Farben in einem Bild? Bei der Gestaltung gilt es eine Handvoll bewährter Regeln anzuwenden, die aus einem Schnappschuss ein anspruchsvolles Photo machen können, und diese Regeln werden in diesem Buch ebenfalls ausführlich vorgestellt. Dabei wird sich zeigen, dass man bei der Bildgestaltung ebenfalls nicht ganz ohne technisches Hintergrundwissen auskommt.

In dem vorliegenden Buch werden daher, neben den Grundlagen, vor allem die Aspekte Technik und Gestaltung betrachtet. Das Buch wird mit einem Kapitel zur digitalen Nachbearbeitung abgerundet und sollte damit jedes Thema behandeln, in dem ein Hobby-Photograph Grundkenntnisse besitzen sollte.

Zielgruppe

[Bearbeiten]Zur Zielgruppe dieses Buches gehören in erster Linie Einsteiger, die kein oder nur wenig photographisches Hintergrundwissen besitzen, jedoch mehr über die Photographie an sich sowie die technischen oder gestalterischen Grundlagen erfahren möchten. Auch Fortgeschrittene werden womöglich den ein oder anderen guten Hinweis finden, auf Spezialwissen wird jedoch weitgehend verzichtet, da dieses für Hobby-Photographen kaum notwendig scheint. Einige relativ spezielle Aspekte sind als Exkurs ausgezeichnet und bieten Hintergrundwissen für besonders interessierte Leser.

Anliegen des Buches ist es, alle Bereiche der Photographie und der eng mit ihr zusammenhängenden Gebiete zu vermitteln. Es wird also sowohl auf analoge als auch digitale Photographie eingegangen, wobei der Schwerpunkt eher auf der weiter verbreiteten digitalen Photographie liegt. Es werden auch Themen wie Farbgestaltung, Bildformate, Nachbearbeitung etc. behandelt und es werden wichtige Fachbegriffe erläutert. Das Buch ist nicht direkt als Nachschlagewerk konzipiert, kann aber natürlich trotzdem zum Nachschlagen bestimmter Themen verwendet werden. Auch für Leser, die sich nur in einem bestimmten Teilgebiet informieren wollen (etwa Bildgestaltung, Belichtung etc.) ist das Buch geeignet – es ist stark thematisch gegliedert.

Ziel des Buches ist ein ausführlicher, verständlicher Einstieg in das recht umfangreiche Sachgebiet – es ist keine Anleitung oder “How-to”. Der Schwerpunkt liegt eher auf dem Verständnis, was manchmal umfangreichere Ausführungen notwendig macht.

Gliederung

[Bearbeiten]Nach dem Vorwort werden die Grundlagen der Photographie vermittelt. Was ist Photographie? Wo wird Photographie angewendet, wie wird sie klassifiziert? Welche Vorteile bringt uns die Photographie, welche Probleme verursacht sie? Was darf man alles photographieren, was darf man veröffentlichen und wer behält am Ende die Bildrechte? Gerade dieses Kapitel wird Fragen klären, die die meisten konventionellen Bücher ignorieren.

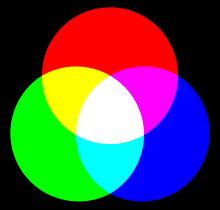

Im Anschluss soll auf die Bildgestaltung näher eingegangen werden. Hierbei werden Dinge betrachtet, die gewissermaßen über der Photographie stehen, das heißt allgemeiner als diese sind: Bildformate, Farbgestaltung, Auflösung, Dateiformate, Entstehung und Wirkung von Farben etc. stehen hier im Mittelpunkt. Das Kapitel ist vor allem für die später behandelte Bildgestaltung wichtig und kann auch für Personen aus anderen Fachgebieten (zum Beispiel Malerei) interessant sein.

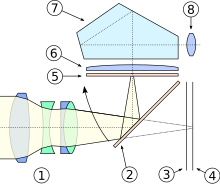

Nach diesen beiden einführenden Kapiteln werden dann technische Bereiche abgedeckt. Im Kapitel “Aufbau und Funktionsweise der Kamera“ soll erläutert werden, welche Arten von Kameras es gibt, wie sie aufgebaut sind und wie das Aufnehmen von Photos technisch funktioniert. Das daran anschließende Kapitel “Das Photographieren” wird technische Hintergründe zum Aufnehmen von Photos zum Hauptgegenstand haben. Was sind Brennweite, Objektiv und Zoom? Wann nimmt man kleine Brennweiten, wann große? Was bedeuten Belichtung, Blende, ISO-Wert und Belichtungskorrektur? Wie hängen sie zusammen und welche Wirkungen lassen sich erzielen? Für den technisch interessierten Leser werden diese beiden Kapitel den Höhepunkt bilden.

Der nächste Teil des Buches betrachtet weniger technische, als viel mehr gestalterische Aspekte und geht damit auf den künstlerischen Charakter der Photographie ein. Es stellt Regeln vor, nach denen Photos aufgenommen werden, um ästhetisch besonders ansprechend zu wirken. Dies ist natürlich immer stark vom photographischen Genre abhängig; daher sollen hier neben fundiertem Grundlagenwissen auch spezielle Tipps zu den einzelnen Genres wie Landschaftsphotographie, Architekturphotographie, Porträts etc. gegeben werden.

Die Nachbearbeitung von digitalen Photos ist heute fast nicht mehr wegzudenken und kann die kaum vermeidbaren Laienfehler und Artefakte oft beheben oder zumindest mildern. In dem letzten Kapitel des Buchs soll daher erläutert werden, welche typischen Möglichkeiten der Nachbearbeitung bestehen und wie diese mit Bildbearbeitungsprogrammen (zum Beispiel Gimp) etwa durchgeführt werden.

Grundlagen der Fotografie

[Bearbeiten]Der Begriff Photographie

[Bearbeiten]Der Begriff Photographie, eingedeutscht auch oft Fotografie (von griech. photos = licht und graphein = malen, zeichnen; etwa "mit Licht malen") hat zwei Bedeutungen. Er bezeichnet einerseits ein physikalisch-künstlerisches Verfahren zur Erstellung von Abbildern der Umgebung und zum anderen das Resultat desselbigen Verfahrens. Das Resultat (die Photographie im zweiten Sinne) bezeichnet damit das dauerhaft gespeicherte Abbild der Realität und wird oft auch einfach als Photo (oft auch Foto), Aufnahme, Bild oder seltener Lichtbild bezeichnet. Der Begriff Bild ist jedoch deutlich allgemeiner als "Photo". Unter einem Abzug versteht man ein Photo der Analogphotographie nach seiner Entwicklung aus dem photographischen Film.

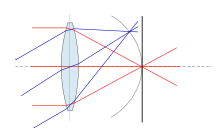

Bei der Photographie entstehen Photos, indem Licht durch das Objektiv einer Kamera auf einen lichtempfindlichen Film (Analogphotographie) oder einen lichtempfindlichen Bildsensor (Digitalphotographie) fällt. Ein Photo zeigt somit eine Abbildung der Wirklichkeit gemittelt über einen ganz bestimmten, meist kurzen Zeitabschnitt. Photos ähneln im Ergebnis in gewisser Weise bestimmten Techniken mit Hilfsgerüsten in der Malerei, wo versucht wurde, einen Ausschnitt der Wirklichkeit auf der flächigen Leinwand möglichst realistisch darzustellen. In beiden Fällen werden Projektionsverfahren, Abbildungen verwendet, um eine Projektion vom Raum auf die Fläche der Leinwand oder beim Photo auf die ebene Fläche des Sensors oder Films zu realisieren. Dabei hat der Maler natürlich mehr subjektive Freiheiten als es der Photograph hat. Die Eigenschaften von Kamera, Objektiv, Sensor oder Film können starken Einfluß darauf haben, wie das konkrete Ergebnis der Abbildung dann aussieht. Es gibt auch eine Vielzahl an Techniken, um Photos unnatürlich wirken zu lassen, so dass Begriffe wie Ausschnitt der Wirklichkeit oder Realität im Zusammenhang mit der Photografie stets relativ zu sehen sind. Die Art der Abbildung und das dazu verwendete Werkzeug ist immer auch Bestandteil des Bildergebnisses.

Photos sind eine Abbildung aus dem dreidimensionalen Raum in den zweidimensionalen Raum. Dabei wird über die meist kurze Belichtungszeit gemittelt - kurz in Bezug auf das Wahrnehmungsvermögen eines Menschen, nicht zwangsläufig in Bezug zur Schnelligkeit manch bewegter Motive, die man gerne aufnehmen möchte. Da das Photo erst betrachtet werden kann, wenn es aufgenommen wurde, folgt daraus, dass jedes Photo bereits einen Moment der Vergangenheit darstellt, wie im übrigen jede Abbildung, denn auch das Licht braucht ja Zeit, um vom Abgebildeten dahin zu gelangen, wo es abgebildet wird.

Photos als reale Abbilder

[Bearbeiten]

Man bezeichnet Photos gern als reale Abbilder der Wirklichkeit. In Wahrheit kann jedoch kein Photo ein tatsächliches Abbild liefern. Wie man spätestens im letzten Jahrhundert in der Physik gelernt hat, sind Begriffe wie Wirklichkeit und Wahrheit philosophische Begriffe. Kameras sind also nur technische Werkzeuge, deren Ergebnisse interpretiert werden müsssen, um etwas über die abgebildeten Objekte zu lernen. Je nachdem, wie das Werkzeug eingesetzt wird, treten andere Aspekte des abgebildeten Objektes hervor oder auch zurück. Auch durch die Auswahl, welche Art von Licht von wo auf das Motiv fällt und dann in die Kamera kann entscheidend beeinflusst werden, in welcher Weise das Motiv auf der Abbildung dargestellt wird. Bei sich zeitlich schnell ändernden Motiven hängt der spätere Eindruck oder die Interpretation des Bildes teils entscheidend davon ab, in welchem Zustand das Motiv aufgenommen wird. Der Zustand zur Aufnahmezeit muss für das Motiv ja nicht charakteristisch sein. Ist die Belichtungszeit nicht mehr kurz im Vergleich zur Geschwindigkeit eines Motivs, so verwischt dieses über Teile der Abbildung. Das kann erwünscht sein oder eben nicht.

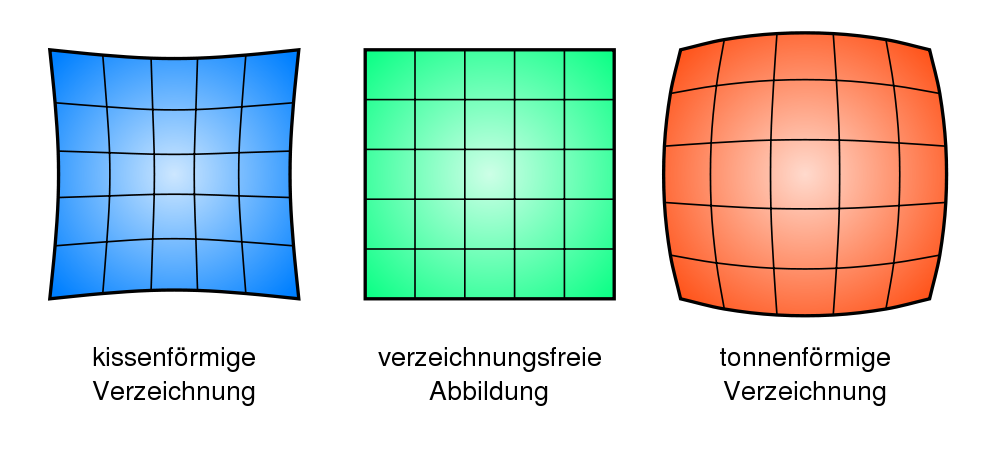

Aus künstlerischer Sicht steht die realistische Wirkung eines Bildes oft auch nicht im Vordergrund. Mit geringer Schärfentiefe und ungewöhnlichem Blickwinkel (Weitwinkel oder Telewinkel) werden beispielsweise ganz bewusst Bilder geschaffen, die zum Teil wenig mit dem ursprünglichen Motiv zu tun haben, wie man es etwa mit den eigenen Augen wahrnehmen würde. Zudem bietet die Bildgestaltung eine Vielzahl an Mitteln, um Photos nachzubearbeiten. Erhöhung von Kontrast und Sättigung, das Hinzufügen von Lichteffekten, das Verändern der Perspektive etc. sind beliebte Mittel. Es wird demnach bewusst ein von der Natur verschiedenes Bild geschaffen. Bereits die Abbildung des Motivs mit dem Objektiv auf die ebene Sensorfläche kann auf recht verschiedene Weise erfolgen. Besonders bei Weitwinkelobjektiven sind charakteristische Verzerrungen erkennbar, die zwangsläufig in irgendeiner Weise auftreten müssen, wenn ein sehr großer Bildwinkel auf einen Sensor bestimmter Größe abgebildet werden soll, der in einem technisch bedingten festen Abstand zum Objektiv angeordnet ist.

Auch wenn man es sich zum Ziel setzt, ein möglichst realistisches Abbild der Natur zu schaffen, das heißt ein Bild, das beim Betrachten der Szene in der Natur zum Aufnahmezeitpunkt entspricht, wird man dies nicht zu 100 % bewältigen können. Kameras sind heute sehr leistungsfähig, es werden beim Aufnehmen von Photos jedoch stets Artefakte entstehen, auch wenn sie oft nicht auffallen oder kaum erkennbar sind. Unter einem Artefakt versteht man in der Photographie sichtbare Abweichungen von der realen Szene (dazu später noch mehr).

Typische Artefakte sind Stiche (zum Beispiel Blaustich, die Farben der Aufnahme sind also deutlich ins Blaue verschoben) und Farbveränderungen, Körnigkeit und Bildrauschen, Blooming und Smear-Effekte (weiße Streifen im Bild, meist bei Lichtquellen), trotz vorhandener Entspiegelung auftretende Spiegelungen besonders der Sonne im Objektiv, Abbildungen der Form der Blende bei unscharfen Lichtpunkten (Bokeh) etc. Nichtsdestoweniger kann man mit geeigneten Kameras und Objektiven bei entsprechend ordnungsgemäßer Aufnahme Abbilder erzeugen, die einen sehr realistischen Eindruck machen.

Einordnung der Photographie

[Bearbeiten]Allgemeine Einordnung

[Bearbeiten]Die Photographie steht zwischen den Naturwissenschaften und den Kunstwissenschaften, das heißt, man kann aus zwei Seiten auf das Fachgebiet schauen. Aus naturwissenschaftlicher Sicht gehört die Photographie am ehesten in den Bereich der Physik, mit dem zentralen Element der Optik. Die analoge Photographie hat auch einen gewissen Bezug zur Chemie (das Aufnehmen eines Photos auf einen Film sowie die Entwicklung desselbigen ist ein chemischer Vorgang), während die digitale Photographie einen recht großen Bezug zur Oberflächenphysik, Mikroelektronik und Informatik besitzt (hinter vielen Kamerafunktionen und Hilfsprogrammen verbergen sich ausgereifte Programme).

Aus künstlerischer Sicht gehört die Photographie im Grunde der Bildenden Kunst an und steht dort dann unter anderem neben Malerei, Graphik, Plastik und Kunstgewerbe. Insbesondere der Bezug zur Malerei ist durchaus eng. Die Photographie wird manchmal auch zur Kommunikations- und Medientechnik gezählt - eine klare Zuordnung zu einem ganz bestimmten Gebiet ist daher, vor allem wegen ihrer Vielfältigkeit, kaum möglich. Die Zuordnung kann sich auch oder vor allem durch die Zielsetzungen des Photographen ergeben.

Abgrenzung zu anderen Kunstformen

[Bearbeiten]Die Photographie hat unter anderem einen engen Bezug zur Malerei und zum Film, obgleich sie ein in sich geschlossenes Gebiet der Bildenden Kunst darstellt.

Im Gegensatz zur Malerei sind mit der Photographie realistische Abbilder möglich und die Photographie kann somit als eine Erweiterung der klassischen Malerei gesehen werden. Mittels photographischer Techniken und digitaler Bildbearbeitung kann die Photographie aber im Grunde alles, was auch die Malerei kann. Ein wesentlicher Unterschied ist jedoch, dass ein Maler aus der Instanz heraus ein beliebiges Bild schaffen kann, ganz nach eigenen Wünschen und Vorstellungen. Ein Photograph muss hingegen nach einem geeigneten Motiv suchen; er muss mit dem Vorlieb nehmen, was sich ihm gerade in der Umwelt anbietet. Insofern unterscheiden sich Malerei und Photographie erheblich. Das Auffinden geeigneter Motive und deren Anordnung in einem Bild ist damit ein ganz entscheidender Punkt in der (künstlerischen) Photographie.

Die Malerei bedient sich manchmal der Photographie. So können Photographien als Vorlagen oder Inspiration für Gemälde verwendet werden. Manche Künstler lassen Photos auch großformatig drucken und übermalen sie dann. Es können auf diese Weise Gemälde geschaffen werden, bei denen Perspektive und Anordnung der Elemente sehr realistisch sind. Bevor die Photographie allgemein gebräuchlich war, gab es besonders für Landschaftsmaler bereits perspektivische Hilfskonstruktionen, die ebenfalls eine realistische Abbildung ermöglicht haben. Diese Methoden sind auch für Einsteiger in die Malerei hilfreiche Mittel. Die älteren Hilfskonstruktionen zur perspektivischen Malerei haben sich auch bei Programmen etabliert, mit welchen versucht wird, allein mit dem Rechner realistische Szenen zu berechnen und darzustellen. So ergibt sich in dieser pseudorealistischen 'Computermalerei' auch ein interessanter Kontrapunkt zur intensiven Nachbearbeitung von Photographien, die dann oft zur Folge hat, dass nachbearbeitete Photographien weniger realistisch abbilden, aber neue, freiere Bildkompositionen bieten, die sich wiederum in einigen Ausprägungen der Malerei nach Bildvorlage annähern. Durch die Vektorisierung von Photos ist es ferner auch möglich, mehr oder weniger stark abstrahierte, comic-artige Darstellungen zu erreichen. Diese können dann zum Beispiel den abstrahierten Drucken von Andy Warhol ähneln, welcher oft ebenfalls von Photographien ausgegangen ist. Die einzige 'Digitalisierung' bei ihm bestand allerdings wohl im Siebdruck, dessen Effekte wiederum von Roy Lichtenstein aufgenommen wurden, um gezielt verfremdete Bilder zu erschaffen. So gibt es also eine kontinuierliche gegenseitige Beeinflussung zwischen Malerei und Graphik auf der einen Seite und Photographie auf der anderen, wobei die Übergänge an einigen Stellen fließend werden.

Der Film, der nicht mehr zur Bildenden Kunst, sondern zur Darstellenden Kunst gehört, wird auch gern mit der Photographie verglichen, vermutlich weil er sich gewissermaßen aus der Photographie heraus entwickelt hat ("bewegte Bilder"). In der Tat gibt es durchaus Gemeinsamkeiten.

Die Optik der Kameras, auch die Sensoren sind ähnlich oder sogar gleich, technisch sind die Ähnlichkeiten so groß, dass es heute oft bereits möglich ist, mit digitalen Photokameras kürzere Filme in HDTV-Auflösung zu drehen, umgedreht können mit Filmkameras oft Photos mit allerdings geringer Pixelzahl aufgenommen werden. Aufgrund der hervorragenden Bildqualität digitaler Sensoren von Spiegelreflexkameras im Kleinbildformat und der großen Auswahl an Objektiven werden sogar zunehmend professionelle Filme mit diesen Kameras aufgenommen.

Filme werden wie Photos über eine Kamera aufgenommen, sie zeigen Abbildungen aus unserer Lebenswelt, sie können aus künstlerischer und angewandter Sicht betrachtet werden und die Trickkiste zur künstlerischen Gestaltung ist ebenso groß wie bei der Photographie (wahrscheinlich ist sie sogar noch um einiges größer).

Tatsächlich gibt es aber auch große Unterschiede zwischen Photographie und Film. Ein Photo soll ganz bewusst einen Moment, einen kurzen Augenblick, festhalten, während ein Film genau das Gegenteil bewirken soll, nämlich eine Handlung beziehungsweise zeitliche oder räumliche Bewegung darzustellen. Im Film verschmelzen meist viele Künste, zum Beispiel Musik/Ton, Bild und Handlung (Literatur), während Photos reine Elemente der Bildenden Kunst sind.

Aus technischer Sicht sind sich Film und Photographie hingegen sehr ähnlich; Brennweite, Blende, Empfindlichkeit, Filmformat, Bildauflösung etc. sind nicht nur Kernbestandteile der Photographie, sondern auch des Films. Da bei einem Film allerdings viele Bilder, etwa 24 pro Sekunde, dargestellt werden, ist es nicht unbedingt notwendig, dass bei jedem Bild etwa bei Bewegungen Bewegungsunschärfen vermieden werden muß. Das menschliche Gehirn kann nicht nur aus den 24 Bildern pro Sekunde eine kontinuierliche Bewegung interpolieren, sondern auch solche Bewegungsunschärfen kompensieren...

Kunstformübergreifende Photographie

[Bearbeiten]Die Photographie ist eine in sich geschlossene Form der Kunst. Die Kombination der Photographie mit anderen Kunstrichtungen erscheint möglicherweise untypisch, ist aber grundsätzlich möglich und in der Praxis auch häufig anzutreffen. Die Bildergeschichte oder der Bilderroman ist ein Paradebeispiel, wo Photographie (Bildende Kunst) und Epik (Literarische Kunst) verschmelzen. Auf einigen Video-Plattformen wie YouTube kann man beobachten, dass zu einem Lied ein Video eingeblendet ist, das verschiedene Photos zeigt (Diaschau). In diesem Fall verschmelzen Musik und Photographie. In der vierten großen Kunstrichtung, der Darstellenden Künste, kann Photographie ebenfalls vorkommen, zum Beispiel als Kulisse beim Theater oder Film.

Unterteilung der Photographie

[Bearbeiten]Arten der Unterteilung

[Bearbeiten]Photographie kann aus verschiedenen Gesichtspunkten klassifiziert werden. Man unterscheidet in der Theorie gern zwischen angewandter und künstlerischer Photographie, in der Praxis eher zwischen Analog- und Digitalphotographie, und besonders oft unterscheidet man zwischen den einzelnen Genres der Photographie.

Angewandte und Künstlerische Photographie

[Bearbeiten]Die angewandte Photographie betrachtet die Photographie aus ökonomischen und kommerziellen Gesichtspunkten. Der Begriff angewandt wird hier auch in dem Sinne verwendet, dass das Photo letztlich Mittel zum Zweck ist und nicht primäres Ziel des Photographierens.

Bekannte Beispiele sind hierbei Werbeaufnahmen, Modeaufnahmen, Porträtaufnahmen beim Photographen, dokumentarische Aufnahmen (zum Beispiel Vorher-Nachher-Aufnahmen, Aufnahmen bei Verkehrsunfällen, Aufnahme von Bauland/Grundstücken etc.) und Sachphotos. Photographie wird hierbei seltener aus künstlerischer oder kreativer Sicht betrachtet, sondern es geht darum, ein Bild für einen ganz bestimmten Zweck aufzunehmen. Berufsphotographen gehören immer auch der angewandten Photographie an, aber auch viele Hobby-Photographen werden bisweilen im Bereich der angewandten Photographie tätig sein (bereits das Photographieren eines Produkts, das im Internet versteigert werden soll, gehört in diesen Bereich). In der angewandten Photographie ist der Photograph in hohem Maß von seinem Auftraggeber abhängig, oder, falls er freiberuflich arbeitet, von seiner Zielgruppe.

Die künstlerische Photographie (auch Photokunst) betrachtet die Photographie als Kunst und hat keine oder maximal nur geringe kommerzielle Absichten. Um die Abgrenzung noch zu verkomplizieren, ist auch zu bedenken, dass mit Kunst von wenigen Künstlern recht viel Geld verdient werden kann, die Motivation zu künstlerischen Schaffen also auch eine kommerzielle sein kann. Bei Kunstwerken ist es jedenfalls primäres Ziel des Handelns, das Werk selbst zu erschaffen und damit gegebenenfalls direkte Wirkung beim Betrachter zu erreichen. Das Werk ist also vorrangig Selbstzweck und ist nicht Mittel zum Zweck.

Viele Menschen, die photographieren, werden den Bereich der Künstlerischen Photographie anstreben. Typische Aufnahmen sind hierbei beispielweise Reiseaufnahmen, Alltagsaufnahmen (Familie, Kinder, Festivals, Ausflüge, Schnappschüsse, Feuerwerk, Sonnenuntergang etc.), aber zum Beispiel auch professionelle Landschafts-, Tier-, Architektur- oder Porträtaufnahmen, sofern kein wirtschaftlicher Nutzen im Vordergrund steht. Photographen der Künstlerischen Photographie sind weder von Auftraggebern und Zielpublikum abhängig, sie haben also unbegrenzte Möglichkeiten. Gerade im Bereich der Photokunst gibt es auch Strömungen hin zum Einfachen, Suboptimalen, etwa zu Lochkameras oder Einzellinsen-Objektiven oder mit einem sogenannten 'Lensbaby', mit dem sich kaum reproduzierbare Bildergebnisse erzielen lassen.

Die meisten Menschen, die heute mit Kompaktkamera oder Mobiltelephon Aufnahmen machen, werden damit weder einen besonderen

kommerziellen noch künstlerischen Anspruch verfolgen.

Sie tun das einfach zum Spaß oder um etwas zur Erinnerung zu dokumentieren oder auch einfach, um das Bild direkt nach der

Aufnahme herumzuzeigen, um sich über irgendetwas mit den Mitmenschen unterhalten zu können.

Von daher können die Bilder nur Mittel zum Zweck sein, also angewandt sein, ohne allerdings kommerziell zu sein.

Mit der nächsten Aufnahme kann aber bereits wieder das Werk selbst im Mittelpunkt stehen.

All dies schließt also nicht aus, dass man mit den gleichen Geräten auch Bilder aufnehmen kann, die für die beiden anderen Kategorien reichen. Allein die Motivation der Akteure läßt sich weder unter kommerzieller Nutzung noch unter Kunst einordnen. Diese Alltagsaufnahmen sind gleichwohl im rechtlichen Sinne Werke, was auch einen weiteren Beitrag zum ewigen Thema liefert, was Kunst eigentlich ist.

Selbst wenn sich angewandte und künstlerische Photographie als solches klar abgrenzen ließen, können ihnen keine Genres eineindeutig zugeordnet werden.

Fast jedes photographische Genre kann also in der angewandten und in der künstlerischen Photographie Gegenstand sein.

Analoge und Digitale Photographie

[Bearbeiten]Die analoge Photographie ist die klassische Photographie, bei der das Photo entsteht, indem Licht auf ein lichtempfindliches Material (Film) trifft und sich dieses derart verändert, dass man mittels chemischer Verfahren daraus ein Bild erzeugen kann. Die analoge Photographie hatte ihren Höhepunkt von etwa 1840 bis 2000, danach nahm ihre Bedeutung durch die sich rasant entwickelnde Digitalphotographie stetig ab. Einige Photographen sind aber noch immer im Bereich der Analogphotographie tätig und Filme unterschiedlichster Art und Preisklasse werden noch immer in verschiedenen Geschäften angeboten.

Bei der digitalen Photographie wird das Bild von einem Bildsensor aufgenommen und direkt in elektronischer Form (Bilddatei) gespeichert. Es liegt also unmittelbar nach der Aufnahme als digitales Bild vor. Dieses Verfahren macht es möglich, dass man sich das Photo sofort auf dem Kamerabildschirm anschauen kann, da es nicht erst noch entwickelt werden muss. Man kann das Photo auch sofort bewerten und gegebenenfalls erneut aufnehmen, falls man mit dem Resultat nicht zufrieden ist. Ein weiterer Vorteil ist, dass man das Bild schnell in andere elektronische Medien (zum Beispiel Computer) übertragen kann. Zudem zeichnet sich die Digitalphotographie meist durch eine recht einfache Bedienung und sehr geringe laufende Kosten aus (Film- und Entwicklungskosten fallen nicht mehr an, sofern man keine Abzüge macht).

Dieses Buch wird sich auf die digitale Photographie konzentrieren, wobei jedoch an gegebener Stelle auch auf die analoge Photographie eingegangen wird.

Schwarzweiß- und Farbphotographie

[Bearbeiten]Mit den Anfängen der Farbphotographie in den 40er Jahren hat man oft zwischen Schwarzweißphotographie und Farbphotographie (beziehungsweise Schwarzweißfilm und Farbfilm) unterschieden. Jedenfalls ging es schon immer bei der Schwarzweißphotographie darum, die einfallende Lichtmenge zumeist in Grauwerten darzustellen, der Begriff ist also eigentlich irreführend. Der Unterschied zwische Farbe oder nur Lichtmenge wird heute kaum mehr vorgenommen, da aktuelle Kameras automatisch Farbphotos aufnehmen. Es gibt allerdings auch digitale Spezialkameras mit hoher Empfindlichkeit, welche dafür auf Farbinformationen verzichten. Mehr als beim klassischen Filmaterial hat die Fähigkeit in Farbe aufzunehmen deutlichen Einfluß auf Empfindlichkeit und Auflösung der Kamera, weil bei den meisten Sensoren die verschiedenen Farbpixel nebeneinander angeordnet sind und jeweils mit Farbfiltern ausgestattet sind. Ein Großteil des auf dem Sensor ankommenden Lichtes wird also für die Aufnahme gar nicht verwendet. Trotz der eigentlich höheren Empfindlichkeit der digitalen Sensoren gegenüber den Filmen reduziert dies die Empfindlichkeit auf ein ähnliches Niveau, was in den besten Fällen auch auf die Auflösung zutrifft.

Lediglich beim Resultat wird noch immer zwischen Farb- und 'Schwarzweißphoto' unterschieden. Ein 'Schwarzweißphoto' welches mit einem Farbsensor aufgenommen wird, verschenkt allerdings gegen einen Sensor, der nur die Lichtmenge aufnimmt, sehr viel Empfindlichkeit. Eine dritte, recht neumodische Art, ist Sepia, ein Photo in gelblich-braunen Tönen, das den Eindruck eines alten Photos macht - dies ist aber eigentlich das gleiche wie ein 'Schwarzweißphoto', es ist danach nur wieder eingefärbt worden.

Photographische Genres

[Bearbeiten]Grundlagen

[Bearbeiten]Eine Vielzahl von Genres orientiert sich daran, was abgebildet wird, das heißt was das Motiv des Bildes ist (zum Beispiel Landschaftsphotographie, Porträtphotographie, Sachphotographie, Industriephotographie). Einige Gebiete hingegen orientieren sich eher am wie, zum Beispiel wie ein Motiv aufgenommen wird beziehungsweise unter welchen Bedingungen und Umständen die Aufnahme stattfindet (zum Beispiel Makrophotographie, Reportagephotographie, Abstrakte Photographie). Es scheint leider keine genaue Bezeichnung für diese Unterscheidung zu geben, daher sollen an dieser Stelle die Begriffe motivbezogene Genres und übergeordnete Genres verwendet werden. Dabei muss bedacht werden, dass manche Genres Merkmale beider Gruppen aufweisen (zum Beispiel Nachtphotographie und Unterwasserphotographie, wo man "Nacht" und "Unterwasser" sowohl als Motiv als auch als Umstand/Aufnahmeweise/Phototechnik sehen kann). Die übergeordneten Genres haben allesamt einen engen Bezug zu einigen (manchmal auch fast allen) motivbezogenen Genres.

Überblick

[Bearbeiten]

Die Wikipedia-Kategorie "Genre der Fotografie", welche diesem Abschnitt zu Grunde gelegt wurde, listet mehr als 40 Genres auf, wobei einige bekannte Genres jedoch fehlen. Man kommt damit schnell auf 50 oder noch mehr Genres. Einige Genres sind sehr bekannt und relativ klar definiert (zum Beispiel Landschaftsphotographie, Architekturphotographie, Sportphotographie), andere sind nur wenig bekannt und weniger klar definiert (zum Beispiel Konkrete Photographie, Experimentelle Photographie). Für den Einstieg in die Photographie ist damit nur eine kleine Anzahl an Genres relevant, es soll aber trotzdem ein umfassender Überblick über die einzelnen Genres gegeben werden.

Es scheint, dass bisher nur wenig Material zur Klassifikation von Photogenres existiert. Die nebenstehende Skizze wurde im Rahmen dieses Buchprojekts angefertigt und ist eine Möglichkeit der Anordnung ausgewählter Genres. Sie kann nur als Orientierung beziehungsweise grobe Übersicht gesehen werden, eben weil die Genres oft unscharf definiert sind beziehungsweise sich schwer abgrenzen lassen.

Das Besondere an dem Schema ist, dass es die Beziehung der Genres untereinander hervorhebt, während in anderen Quellen die Genres sonst oft einfach nach Bedeutung oder Alphabet aufgelistet werden. Für den Einsteiger sollte es damit leichter sein, einen schnellen Überblick der Genres zu gewinnen. Sie werden aber im nächsten Abschnitt auch noch einmal textuell kurz erläutert.

Die dunkelblauen Ellipsen stellen die wichtigsten motivbezogenen Genres dar, die hellblauen Ellipsen weniger bekannte Genres (Spezialgenres). Die gelben Ellipsen stellen analog wichtige übergeordnete (technik-bezogene) Genres dar. Die links im Bild angeordneten orangen Ellipsen stellen übergeordnete Genres dar, die fast alle anderen Genres enthalten können (universelle Genres). Bei diesen Genres wurde darauf verzichtet, die Beziehungen zu anderen Genres einzutragen, da dies das Schema sehr unübersichtlich gemacht hätte.

Kanten (Pfeile) stellen Beziehungen zwischen Genres dar. Ein durchgezogener Pfeil zeigt ein Subgenre an (Teilmenge, Untergattung), was jedoch nicht heißt, dass dieses nicht gleichzeitig auch Subgenre eines anderen Genres sein könnte (Polyhierarchie). Eine gestrichelte Linie besagt, dass es zwar eine deutliche Beziehung zwischen beiden Genres gibt, jedoch nicht unbedingt von einer Untermengen-Beziehung gesprochen werden kann. So gibt es eine enge Beziehung zwischen Architektur- und Industriephotographie, die Industriephotographie ist aber keine echte Untergattung der Architekturphotographie, da sie andere Zielstellungen und Methodiken verfolgt. Am Beispiel von Straßenphotographie und Porträtphotographie wird die Beziehung ebenfalls deutlich. Es gibt gewisse Gemeinsamkeiten (Abbildung von Personen), aber auch deutliche Unterschiede (ungestellte, alltägliche Aufnahmen in Städten bei der Straßenphotographie). Punktierte Linien zeigen eine Beziehung zwischen übergeordneten Genres und motivbezogenen Genres an. Eine punktierte Linie, die sich auf ein gewisses Genre bezieht, bezieht sich dann auch automatisch auf dessen Subgenres, um die Zahl der Kanten in dem Bild gering zu halten. Die Kante zwischen Reisephotographie und Landschaftsphotographie besagt damit, dass Landschaftsphotographie ein typisches Genre der Reisephotographie ist, ebenso aber auch die Subgenres Natur- und Tierphotographie.

Durchgezogene und gestrichelte Kanten treten somit zwischen den motivbezogenen Genres auf sowie zwischen den übergeordneten Genres. Punktierte Linien treten hingegen nur zwischen den beiden Grundarten von Genres auf, schlagen also gewissermaßen die Brücke zwischen motivbezogenen und übergeordneten Genres.

Motivbezogene Genres

[Bearbeiten]

Die Landschaftsphotographie ist ein weitreichendes Genre, das die Umwelt des Menschen zum Hauptgegenstand hat. Sie kann noch einmal in die einzelnen Jahreszeiten (Frühling, Sommer, Herbst, Winter) und einzelnen Landschaftstypen (Wald, Feld, Sand, Meer, Gebirge etc.) unterteilt werden, wobei diese Gebiete jedoch meist nicht als Genres betrachtet werden.

Die Naturphotographie kann als Untergenre der Landschaftsphotographie gesehen werden. Während letztere eher große Ausschnitte zeigt (sogenannte Übersichtsphotos), wird in der Naturphotographie eher ein kleiner Ausschnitt ausgewählt, zum Beispiel ein Baum, Blumen, Tiere etc. Bei der Abbildung von Tieren spricht man dann von der Tierphotographie (auch Wildlife-Photographie).

Werden Aufnahmen unter Wasser gemacht, so spricht man von der Unterwasserphotographie.

Die Astrophotographie ist ein recht spezielles, unter manchen Hobby-Photographen aber sehr beliebtes Genre. Zudem hat es für wissenschaftliche Zwecke eine hohe Bedeutung. Unter dem Begriff versteht man nicht nur, wie der Name es andeutet, die Photographie von Sternen, sondern allgemein die von Objekten im Weltraum außerhalb der Erde. Das Genre lässt sich nur schwer in die Klassifikation einordnen. Einerseits scheint es zumindest im weitesten Sinne einen Bezug zur Landschafts- oder Naturphotographie zu besitzen, sofern jedenfalls die Auflösung der Bilder reicht, um Landschaften auf dem Mond, Planeten oder der Sonne darzustellen. Betrachtet man hingegen einige Himmelskörper als Gegenstände oder Sachen, so lässt sich ein gewisser (wenn auch ebenso vager) Bezug zur Sachphotographie feststellen. Am größten scheint noch der Bezug zur Nachtphotographie zu sein, da die Astrophotographie für gewöhnlich in der Nacht praktiziert wird, sofern nicht gerade die Sonne aufgenommen wird. Mond und Planeten, auch Sterne haben von der Erde aus gesehen eine relativ geringe Leuchtstärke, daher treten einige technische Probleme in der Nachtphotographie und der Astrophotographie ähnlich auf. Bei der Astrophotographie und bei den dabei oft notwendigen längeren Belichtungszeiten ist allerdings in der Regel spezielles technisches Gerät notwendig, um die Bewegungen der Erde und der beobachteten Himmelskörper automatisch nachzuführen. Zudem haben die Motive von der Erde aus gesehen immer einen sehr kleinen Blickwinkel, man benötigt also für formatfüllende Aufnahmen sehr lange Brennweiten. Zu dem Zwecke wird die Kamera oft auch über Adapter mit einem Teleskop verbunden. Aufgrund des großen Abstandes der Motive kann allerdings immer mit offener Blende gearbeitet werden.

Die Feuerwerks-Photographie ist ein im deutschsprachigen Raum wenig bekannter Begriff; die meisten Kameras bieten jedoch einen Feuerwerk-Modus, so dass man es auch als ein Genre betrachten kann. Diese wird oft mit Stativ und langen Belichtungszeiten betrieben, um die Spuren der Leuchtkörper aufnehmen zu können.

Die Porträtphotographie hat im klassischen Sinne Menschen zum Hauptgegenstand, im weiteren Sinne umfasst sie jedoch auch die Abbildung von Tieren (Tier-Porträt), so dass in diesem Fall die Tierphotographie sowohl Untergenre der Porträtphotographie als auch der Naturphotographie ist. Die Porträtphotographie zielt meist darauf ab, die Wesenszüge einer Person in einem Photo herauszuarbeiten beziehungsweise darzustellen.

Bekannte Untergenres sind Kinderphotographie, Gruppenphotographie, Hochzeitsphotographie und Aktphotographie. Im letzteren liegt der Schwerpunkt auf der Darstellung des menschlichen Körpers, nicht auf der Herausarbeitung der Charakteristik. Die Erotik-Photographie geht über die Aktphotographie hinaus, indem auch ein sexueller Bezug zu erkennen ist (dieser ist der Aktphotographie fremd). Im rechtlichen Sinne gibt es auch noch einen Unterschied zwischen Erotik-Photographie und Pornographie, wobei letztere gezielt sexuelle Interaktivität darstellt. Von daher kann sowohl die Motivwahl als auch die Veröffentlichungen von Pornographie rechtlichen Einschränkungen unterliegen, während dies bei Erotik nicht der Fall ist - im jedem Einzelfall ist also eine Beurteilung der korrekten Einordnung rechtlich relevant für den Photographen und die Personen, die die Aufnahmen veröffentlichen.

Planking ist eine neumodische photographische Erscheinung, bei der sich eine Person mit dem Gesicht nach unten und seitlich angelegten Armen in steifer Körperhaltung photographieren lässt. Die Theaterphotographie (Bühnenphotographie) zeigt Menschen und Kulissen auf der Bühne und hat damit ebenfalls einen gewissen Bezug zur Porträt-Photographie. Die Modephotographie bezeichnet das Photographieren von Kleidern und bekleideten Personen und steht damit etwas zwischen Porträt- und Sachphotographie, je nach dem ob der Schwerpunkt eher auf der Person oder den Kleidern liegt (zum Beispiel für einen Versandhauskatalog).

Die Eventphotographie ist ein eher unscharf definiertes Genre, das Photographien bezeichnet, die auf "Events" (also bei verschiedenen Ereignissen wie Stadtfeste, Konzerten etc.) beziehungsweise zu bestimmten Anlässen (zum Beispiel Hochzeit) aufgenommen werden. Als ein untergeordnetes Genre kann dabei die Konzertphotographie gesehen werden, welche das Photographieren speziell von Konzerten (und insbesondere den Künstlern beziehungsweise Musikern und des Publikums und der Aufbauten) zum Gegenstand hat.

Die Architekturphotographie hat Bauwerke aller Art zum Gegenstand, darunter historische und moderne Gebäude, Skulpturen und Springbrunnen, Brücken, Staudämme, Industrieanlagen und vieles mehr. Innenaufnahmen und Architekturdetails (zum Beispiel Erker, Dachgaupen, Säulen, Tore, Torbögen, Gewölbe, Ornamente etc.) sind besonders beliebte Motive in der Architekturphotographie.

Die Sachphotographie bezeichnet die Abbildung von Gegenständen aller Art und bezieht sich häufig auf die Angewandte Photographie. Hierbei können beliebige Objekte abgebildet werden, zum Beispiel Artikel für einen Produkt- oder Versandhauskatalog. Im letzten Fall spricht man von der Produktphotographie, also der Abbildung jeglicher Produkte, die Ergebnisse eines Produktionsprozesses sind. Das wenig bekannte Gebiet Food-Photographie bezeichnet dabei das Photographieren von Lebensmitteln bis hin zu ganzen Menüs oder Imitationen derselben, meist zum Erstellen von Speisekarten, Netzwerk-Präsenzen von gastronomischen Unternehmen etc. Die Stillleben-Photographie hat einen ausgesprochen künstlerischen Charakter und fällt weniger in das Gebiet der Angewandten Photographie – sie bezeichnet die wohlüberlegte Auswahl und Anordnung verschiedener, unbelebter Gegenstände in einem Photo.

Die Industriephotographie hat Industrieerzeugnisse sowie den Industrieprozess im Mittelpunkt. Sie hat damit einen gewissen Bezug zur Architekturphotographie und zur Sachphotographie.

Die Straßenphotographie ist ein Genre, das gewissermaßen zwischen Architektur- und Porträtphotographie steht und ein Abbild des alltäglichen, öffentlichen Lebens (vor allem in Städten) zum Ziel hat.

Übergeordnete Genres

[Bearbeiten]Die Nachtphotographie bezeichnet bei Nacht oder in der Dämmerung entstandene Photos. Sie hat einen Bezug zu vielen anderen Genres, vor allem Architektur-, Landschafts- und Straßenphotographie.

Die Reisephotographie umfasst auf Reisen aufgenommene Photos und hat einen engen Bezug zur Straßen- und Architekturphotographie, Landschafts- und Porträt-Photographie. Sie kann auch Teil der Dokumentarischen Photographie und Reportagephotographie sein.

Die Luftbildphotographie (manchmal auch einfach Luftphotographie) bezeichnet Bilder, die aus der Luft aufgenommen wurden, zum Beispiel aus einem Heißluftballon oder Flugzeug, oder aber von einem Hochhaus, Aussichtsturm oder Berg. Eine Sonderform ist die Satellitenphotographie, bei der Photos von einem Satelliten auf die Erde herab aufgenommen werden.

Die Panoramaphotographie beschäftigt sich mit der Aufnahme von Panoramen, also von Photos mit sehr großem Bildwinkel (bis 360°-Bilder). Das sind typischerweise Stadtansichten oder Landschaften.

Die Makrophotographie bezeichnet die volle Abbildung kleiner Gegenstände oder Lebewesen, etwa Blumen, Insekten, Spielfiguren etc. Bei Abbildungen von noch kleineren Motiven spricht man von der Mikrophotographie (Abbildung von Dingen, die mit bloßem Auge nicht mehr erkennbar sind).

Die Abstrakte Photographie (selten auch Gegenstandslose Photographie) beeindruckt durch Formen, Muster, Linien, Strukturen und besondere Farben. Es geht nicht mehr um den abgebildeten Gegenstand (dieser lässt sich in dem Photo oft auch kaum mehr erkennen), sondern rein um die Strukturen und Farben. In abstrakten Photos erkennt oft jeder Betrachter etwas Verschiedenes – das macht die abstrakte Photographie besonders interessant.

Die Konkrete Photographie ist nicht (!) das Gegenstück zur Abstrakten Photographie; sie zeichnet sich dadurch aus, dass sie mehr Wert auf die Interpretation eines Fotos beziehungsweise auf die dahinterliegende Bedeutung legt als auf die eigentliche Abbildung desselbigen. Ein Glas Wein kann somit beispielsweise auch Weisheit, Alter oder Alkoholabhängigkeit symbolisieren – liegt der Schwerpunkt eher auf der Bedeutung und Interpretation des Bildes, weniger auf der photographischen Darstellung des Weinglases, so spricht man von Konkreter Photographie. Manchmal können Konkrete und Abstrakte Photographie damit recht eng beieinander liegen (aus abstrakten Photos lassen sich oft auch interessante Dinge interpretieren).

Die Subjektive Photographie hat einen engen Bezug zur Abstrakten und Konkreten Photographie. Ihr geht es, wie bei der Abstrakten Photographie, nicht um Gegenstände, sondern rein um die Wirkung von Formen und Mustern. Wie bei der Konkreten Photographie spielt die Interpretation des Bildes eine sehr große Rolle.

Die Gegenständliche Photographie ist ein weitreichendes, nur wenig bekanntes Genre. In Anlehnung an "Gegenständliche Kunst" bezeichnet es das Gegenstück zur Abstrakten Photographie. Photos der Gegenständlichen Photographie bilden also Gegenstände beziehungsweise Lebewesen aller Art (Menschen, Gebäude, Landschaften etc.) in mehr oder weniger realistischer Form ab. Der Betrachter soll sich an dem abgebildeten Motiv erfreuen, eine tiefere Intention des Künstlers besteht nicht.

Die Experimentelle Photographie ist ein besonders künstlerisches Genre, bei der durch Experimente mit Belichtungszeit, Blende und Brennweite sowie durch spezielle Kamerahaltung und Bildbearbeitung künstlerisch ausgefallene Photos entstehen. Zum Einsatz kommen hier auch besondere Linsenkonstruktionen und Kameras, um zum Beispiel Abbildungsfehler oder -eigenschaften der verwendeten Objektive gezielt zu nutzen, um besondere Effekte zu erzielen. Je nach Verfahren können diese auch in den Bereich der Abstrakten Photographie fallen.

Die Dokumentarphotographie strebt die möglichst exakte Darstellung des Motivs in einem Photo an, hat jedoch eine konkrete Aussagekraft, meist mit sozialkritischem Ausdruck. Eine Dokumentarphotographie kann dabei politische, gesellschaftskritische oder kulturelle Aussagekraft besitzen. Sie enthält eine Botschaft, die über den eigentlichen Text einer Dokumentation hinausgeht. Eine Untergattung ist die Straight Photography (Reine Photographie), bei der die Bilder so realistisch wie möglich sein sollen (keine Unschärfe, keine Nachbearbeitung), wo jedoch meist keine konkrete Aussagekraft beziehungsweise Intention vorliegt. Die Wissenschaftliche Photographie meint Photographie zum Zweck der Analyse und Dokumentation. Sie möchte meist sehr präzise, realistische Bilder bewirken und verfolgt sehr individuelle Ziele. Je nach wissenschaftlicher oder technischer Ausrichtung kann es rein darum gehen, Resulate zu dokumentieren (Archäologie, Biologie). Es besteht aber auch die Möglichkeit mit geeignetem Gerät anhand der Aufnahmen nachträglich Vermessungen von Objektproportionen vorzunehmen. Wissenschaftliche Photographie fällt damit ins Gebiet der Angewandten Photographie.

Die Reportagephotographie (auch Photojournalismus oder Bildberichterstattung) hat die Photographie von verschiedenen Ereignissen im Sinne der Berichterstattung zum Gegenstand. Sie bezieht sich meist auf Politik, Wirtschaft und Gesellschaft und arbeitet eng mit Nachrichtenagenturen und Printmedien-Agenturen zusammen.

Die Werbephotographie stellt Objekte für Werbezwecke dar und wird meist von Werbeagenturen in Auftrag gegeben. Dabei kann sie fast jedes photographischen Genres bedienen, da es bei Werbephotographie vor allem auch darum geht, abstrakte Dinge wie Gesundheit, Sport, Sicherheit, Kraft etc. in einem Photo mit geeigneten Mitteln auszudrücken.

Die Tabletop-Photographie (Aufnahmen von Objekten, die auf einem Tisch angeordnet sind) bezeichnet ein Genre, bei der einfache Gegenstände auf einer meist weißen, geraden Oberfläche (zum Beispiel auf einem Tisch) in einfachster Weise abgebildet werden. Sie hat damit einen engen Bezug zur Sach-, Produkt- und Werbephotographie. Es können allerdings auch durch Variation der aufgenommenen Objekte Bildergeschichten erzählt werden, wodurch sich wieder Verknüpfungen zu anderen Genres und Kunstgattungen ergeben.

Die Stock-Photographie ist ein sehr weites Genre, bei der Photos "auf Vorrat" (englisch: 'on stock') aufgenommen werden. Vor allem Fernsehsender und Zeitschriften sind an Stock-Photos interessiert, um für die Erstellung einer bestimmten Reportage beziehungsweise eines Artikels sofort entsprechende Photos zur Verfügung zu haben, ohne sie dann noch aufnehmen oder besorgen zu müssen. Im Internet existieren heute einige Projekte, die Millionen frei verfügbarer Bilder anbieten und somit als eine Art "Stock-Archiv" fungieren. Ein bekanntes Beispiel ist wikicommons. Bereits an dem Beispiel ist zu erkennen, dass die Bilder nicht notwendig für den Zweck der Bevorratung aufgenommen sein müssen, sie können auch unabhängig von diesem Zweck entstanden sein, wodurch sich praktisch eine Verknüpfung mit belieben anderen Genres ergeben kann. Werden wirklich Photos rein auf Vorrat gemacht, werden diese meist komplett losgelöst von sonstigem Kontext aufgenommen, um eine Verwendung in beliebigem Zusammenhang zu erleichtern.

Gesellschaftliche Aspekte, Vorteile, Nachteile

[Bearbeiten]Bedeutung in der Gesellschaft

[Bearbeiten]Die Photographie hat heute eine sehr hohe Bedeutung und Verbreitung, wobei diese manchmal als solches gar nicht bewusst wahrgenommen wird. Fast jede Person besitzt eine Kamera und hat bereits einmal Photos aufgenommen; ein großer Teil wird sogar regelmäßig Photos aufnehmen. Wer Photos aufnimmt, agiert im Bereich der Bildenden Kunst, auch wenn er oder sie dies nicht als solches wahrnimmt. Es ist somit durchaus nicht falsch zu behaupten, dass die Bildende Kunst mit der hohen Verbreitung der digitalen Photographie seit Beginn des 21. Jahrhunderts eine Renaissance erfährt. An diesem Punkt knüpft auch hier einmal mehr die unendliche Diskussion an, was Kunst ist. Braucht es etwa immer einen Menschen als Künstler oder ist es plötzlich keine Kunst mehr, wenn die Aufnahmen rein von Maschinen aufgenommen werden? Im rechtlichen Sinne braucht es immer einen Urheber, um ein schützenswertes (Kunst-)Werk entstehen zu lassen. Werden Photos von Menschen gemacht, wird diesen generell ein Werk-Charakter zuerkannt, den Aufnahme von Maschinen hingegen folgerichtig nicht, auch wenn diese manchem Schnappschuss gegenüber deutlich überzeugendere Ergebnisse liefern mögen.

Photos beziehungsweise Bilder werden visuell vom Menschen wahrgenommen, das heißt, ähnlich wie Text mit den Augen erfasst. Anders als Text kann das menschliche Auge ein gewöhnliches Bild jedoch innerhalb etwa einer Sekunde vollständig wahrnehmen und erfassen, während es schon für einen einzelnen Satz mehrere Sekunden benötigt (und oft auch etwas Zeit, um den Satz gedanklich zu verstehen). Aus diesem Grund nehmen wir Photos deutlich intensiver wahr und werden durch sie eher aufmerksam gemacht als durch (längere) Texte. Für die Marketingabteilungen der Unternehmen und Institutionen sowie für die Medien spielt diese Erkenntnisse eine große Rolle; eine Welt ohne Bilder ist kaum mehr vorstellbar.

Allerdings läßt sich der Spruch, 'ein Bild ersetzt tausend Worte' auch umkehren, ein paar wohldurchdachte Worte können auch tausende von Bildern ersetzen, wenn sie zentrale Ideen vermitteln. Das menschliche Gehirn ersetzt gesehene Objekte ohnehin durch Ideen, Sprache ist also in gewisser Weise eine Abkürzung gegenüber der Abbildung. Allerdings vermag man mit Bildern auch gut in jenen Bereich des Gehirns vordringen, wo aus gesehenen Objekten Ideen identifiziert werden, von daher kann es so einfacher gelingen, Botschaften am Bewußtsein vorbei ins Gehirn dringen zu lassen.

Eine besondere Brisanz haben Bilder auch hinsichtlich der Zugänglichkeit und Barrierefreiheit von Information, weil sie anders als digitale Textinformation nur schlecht barrierefrei zugänglich zu machen sind. Besonders bei Veröffentlichungen im Internet ist der Autor somit auch immer gefordert, gleichzeitig äquivalente Texte anzubieten, um die beabsichtigte Information allgemein zugänglich zu machen. Das Veröffentlichen von Photos in diesem Sinne schult also auch die Fähigkeit, die Funktion von Bildern einzuordnen und damit auch die Ideen und Vorstellungen explizit zu formulieren, welche mit den Bildern vermittelt werden sollen. Solche semantischen Äquivalente können ganz allgemein sehr wichtig sein, um bei der Interpretation von Intentionen und Absichten zu helfen. Die Vorschläge hinsichtlich der Zugänglichkeit von Information und auch das dominierende Format (X)HTML formuliert die Äquivalenz sogar so stark, dass Pixelbilder ohne Textalternative keine inhaltliche Relevanz haben, also per Definition rein dekorativ sind. Verzichtet ein Autor also auf eine Textrepräsentation bei einer Veröffentlichung im Internet, so bringt er damit explizit zum Ausdruck, dass mit dem Bild keine Intention oder inhaltlich relevante Information verbunden ist, dass es rein dekorativ ist.

Photos als Information

[Bearbeiten]Photographien können wie Texte und Klänge allgemein als Informationen aufgefasst werden; es gibt demnach eine syntaktische, semantische und pragmatische Sichtweise auf Photos.

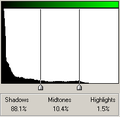

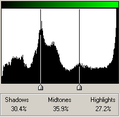

Betrachtet man Photos syntaktisch, so sind sie einfach eine Anordnung von Bildpunkten (Pixeln), die unterschiedliche Farben aufweisen. Man kann auf dieser Ebene verschiedene Analysen durchführen (zum Beispiel Farbverlauf, Farbverteilung, Kontrast etc.). Auf semantischer Ebene sieht man die Bedeutung eines Photos. Hier betrachtet man nicht mehr die Bildpunkte, sondern das, was diese eigentlich zeigen, zum Beispiel ein Hochhaus, eine Berglandschaft, eine Person etc. Dies impliziert im menschlichen Gehirn einem komplexen Prozess, bei dem der Farbverteilung die Abbildung von Objekten zugeordnet werden. Diese Abbildungen werden wiederum mit den abgebildeten Objekten assoziiert. Auf dieser Ebene werden Photos für gewöhnlich Genres zugeordnet. Darüber schließt sich die pragmatische Ebene an, welche die Wirkung des Photos bezeichnet. Diese ist individuell verschieden, bei jedem Menschen kann sich beim Betrachten des Photos eine andere Wirkung einstellen. Das Photo kann als schön oder unschön empfunden werden, als interessant, abstoßend, verwirrend, imposant etc. Es können also jeweils andere Ideen, Interpretationen und Emotionen mit dem Dargestellten assoziiert oder hervorgerufen werden.

Bei Photos geht es oft um die pragmatische Ebene; der Künstler möchte mit seinen Photos eine bestimmte Wirkung erzielen, wobei ein schön anzuschauendes Photo oft, aber bei weitem nicht immer, das Ziel ist. Darin unterscheiden sich Photos nicht allzu sehr von Texten, wo es ebenfalls einerseits um die Bedeutung (Semantik) geht, gleichzeitig aber zumeist auch eine konkrete Wirkung beabsichtigt ist. In der Werbe- und Modephotographie soll ein Photo vor allem Aufmerksamkeit erregen und Interesse beim Betrachter auslösen. Photos können auch eine politische Aussage haben, gesellschaftliche und soziale Missstände ausdrücken oder eine historische Aussagekraft besitzen - die Möglichkeiten auf pragmatischer Ebene sind nahezu unendlich.

Auswirkungen, Nutzen

[Bearbeiten]Viele Personen haben heute stets eine Digitalkamera bei sich, oft auch in Form eines Mobiltelephonen mit eingebauter Kamera. Ein Phänomen ist daher die ab etwa 2000 deutlich gestiegene Meldung und Dokumentation von Ereignissen, zum Beispiel Naturkatastrophen und Unglücken. Hier können Photos und Videos zur Aufklärung erheblich mit beitragen, durch die Betonung spektakulärer Ereignisse aber auch die Wahrnehmung für 'das Normale' verzerren, denn es werden natürlich viel mehr Bilder veröffentlicht, auf denen etwas Außergewöhnliches passiert als solche, die nichts Außergewöhnliches zeigen. Überspitzt könnte man also auch formulieren, normal ist, was nicht abgelichtet wird.

Wie bereits erläutert, hat die Photographie im Bereich der angewandten Photographie eine hohe kommerzielle Bedeutung, zum Beispiel für Werbeaufnahmen, Produktkataloge und Dokumentation. Hier hat sie fast alle Bereiche des Lebens erobert. Photos werden auch gern zur Dekoration benutzt, zum Beispiel im Wohnzimmer, in Restaurants und öffentlichen Sälen, in Korridoren etc.

Da Photos vom Menschen sehr stark wahrgenommen werden, bieten sie sich oft auch an, auf verschiedene (gesellschaftliche) Probleme hinzuweisen. Sozialkritische Photos, wie man sie manchmal in Zeitungen und Magazinen findet, können einen hohen Einfluss auf den Betrachter haben. In den Medien veröffentlichte Bilder und Videos von Krisengebieten haben somit manchmal ungewöhnlich hohe Spendenbereitschaft ausgelöst, die durch rein textuelle Berichterstattung womöglich nicht entstanden wäre.

In der Künstlerischen Fotografie sind Photos das Resultat künstlerischen und individuellen Schaffens und haben somit im Allgemeinen einen hohen persönlichen Wert. Photos speichern vor allem auch Erinnerungen und sind als solches unbezahlbar. Ein verlorengegangenes Erinnerungsbild kann im Grunde nicht wiederhergestellt werden, da Photos stets einen Ausschnitt der Vergangenheit festhalten.

Darüber hinaus schätzen viele (Hobby-)Photographen natürlich den künstlerischen Aspekt. Es gibt viele Methoden, professionelle und beeindruckende Photos aufzunehmen, genauso spannend kann es aber sein, durch Ausprobieren und Nachbearbeiten interessante Resultate zu schaffen. Nach dem Aufnehmen teilen viele Photographen ihre Werke gern mit anderen Menschen, weshalb im Internet eine Vielzahl an Photo-Plattformen existieren. Das Archivieren von Photos spielt dabei eine große Rolle, da man bei vielen Aufnahmen schnell den Überblick verlieren kann.

Einige Photographen ziehen es vor, ihre Photos nicht zu veröffentlichen. Auch für rein persönliche Zwecke gibt es eine Vielzahl an Möglichkeiten, wofür man die aufgenommenen Photos verwenden kann: In (digitalen) Bilderrahmen, als Diaschau, Bildschirmschoner oder Arbeitsflächenhintergrund des Rechners, zum Erstellen von Postern, Collagen und Photobüchern, die heute von vielen (Netzwerk-) Anbietern auf Wunsch gedruckt werden, zum Erstellen eines Familien- oder Urlaubalbums, als Grundlage für Zeichnungen und Gemälde (Verschmelzung von Photographie und Malerei), zum Bedrucken von T-Shirts, zum Gestalten von Internet-Projekten oder Präsentationen und für viele andere Sachen.

Probleme, Missstände

[Bearbeiten]Einige Kritiker sehen mit der aufkommenden Massenphotographie ein gesellschaftliches Problem. Auf Photo-Seiten und in privaten Archiven lagern oft derart viele Photos, dass man diese kaum mehr überblicken kann; Besucher solcher Seiten bekommen keine Auswahl bemerkenswerter Photos, sondern müssen selbst eine Auswahl treffen. Das Thema Massenphotographie ist damit aber eher nur ein Teilaspekt des deutlich umfangreicheren Themas Informationsflut. In diesem Zusammenhang scheint die Qualität der Photographien unter Laien heute oft gering - während die Analogphotographie noch mit laufenden Kosten verbunden war und man sich wohl überlegt hat, was man photographiert und was nicht (und noch deutlich mehr darauf geachtet hat, ein möglichst gutes Bild zu erzielen), sind Schnappschüsse heute oft die Regel. Bedingt durch die Digitalisierung und der Möglichkeit aller, Information für alle im Internet anzubieten, sorgt die weite Verbreitung und Veröffentlichung von gezielt manipulierten Bildern auch für eine deutlich Verunsicherung des Publikums. Der ehemalige Anspruch journalistischer Bilder, einen weitgehend realistisches Abbild von Ereignissen und Aspekten der Welt zu bieten, wird heute mehr und mehr durch eine virtuelle Welt verdrängt, in der beliebige und synthetische Bilder Emotionen und Meinungen steuern können, ohne auf realen Gegebenheiten gründen zu müssen. Zudem ist für den Laien praktisch nicht überprüfbar, in welcher Weise die Bilder oder Nachbearbeitungen oder Kreationen unseren Eindruck von den Dingen manipulieren, welche sie darzustellen scheinen. Während bei Texten meist recht viel Zeit und Gelegenheit zur kritischen Reflexion bleibt, ist es gerade der direkte Einfluß der Bilder auf das Gehirn ohne bewußte Kontrolle, welche das Publikum überfordern können. Wer die Dinge nicht selbst untersucht und sich auf die Abbildungen anderer verläßt, kann ruhig den Mut haben, sich des eigenen Verstandes zu bedienen, wenn die Bilder von der Welt falsch und manipuliert sind, werden damit keine zutreffenden Schlüsse möglich sein.

Auch für kritische Zeitgenossen ergeben sich unmittelbare Konsequenzen - sofern möglich ist immer eine kritische, zweifelnde Distanz zum Dargestellten zu wahren. Das Photo verliert seinen Informationsanspruch und ist wie alles Menschenwerk als möglicherweise manipulative Meinungsäußerung einzustufen oder als reine Dekoration und Unterhaltung. Die Frage der Bewertung der Relevanz der Information verschiebt sich wie bei anderen Medien auch mehr hin zu den Personen, die die Abbildungen bereitstellen - sind diese vertrauenswürdig oder wie kann ihre Vertrauenswürdigkeit zuverlässig eingeschätzt werden? Je nach Thema der Auseinandersetzung ist das mehr oder weniger relevant. Glaubt man vielleicht, noch nicht weiter hinterfragen zu müssen, ob etwa eine Abbildung einer Sonnenblume eine solche zeigt, mag es teilweise schon brisant werden, wenn mehrere Personen auf einem Bild erscheinen - waren die wirklich einmal in der Vergangenheit so zusammen und wurde das wirklich mit der Aufnahme dokumentiert oder wurden die nur nachträglich zusammenmontiert? Und selbst beim Bild der Sonnenblume - sind die sichtbaren Details Artefakte einer Optimierung oder Nachbearbeitung des Bildes oder handelt es sich um Eigenschaften der Sonnenblume, die unabhängig von anderen Photographen reproduziert dargestellt werden können? Immerhin ähneln sich Sonnenblumen, was eine prinzipielle Überprüfung an ähnlichen Sonnenblumen ermöglicht. Bei Aufnahmen von einmaligen Ereignissen bleiben hingegen nur die Aufnahmen selbst, die forensisch untersucht werden könnten.

Die vermeintliche Nachweisbarkeit von Sachverhalten mit Photos kollidiert hier auch mit der Jahrtausende bewährten Lebenserfahrung, dass die Vergangenheit Vergangenheit bleibt und nicht objektivierbar wieder hervorzerrbar ist. Wie irgendein Photo eine Szene zeigt, haben sie die Beteiligten vielleicht gar nicht in Erinnerung. Was nur für den Moment gedacht war, witzig oder unterhaltsam war, war von den Beteiligten gar nicht für die 'Ewigkeit' bestimmt, findet sich aber plötzlich irgendwie für jeden zugänglich im Internet wieder. Wiegt plötzlich die scheinbar 'objektive Wahrheit' der Bilder schwerer als die eigene Bewertung? Führen die vielleicht nicht einmal zur Veröffentlichung autorisierten Bilder zu einer unerwünschten Bewertung der eigenen Person durch andere Menschen jetzt oder in der Zukunft? Auf einmal veröffentlichten Bildern können die Schatten der Vergangenheit sehr lang werden. Auf manipulierten Bildern können sogar nachhaltige Schatten erzeugt werden, die gar nicht zur eigenen Vergangenheit gehören, aber die Zukunft massiv beeinflussen können.

Photographie wird oft auch zu kriminellen Zwecken missbraucht. Bekannte Beispiele sind Bedrohung, Erpressung und (Industrie-) Spionage sowie Datenschutz- und Urheberrechtsverletzungen; die ersten Punkte sind dabei vermutlich bereits so alt wie die Photographie selbst.

Mit dem Aufstieg der digitalen Photographie und des Internets wurde die Photographie auch zunehmend für schwere Straftaten wie Mobbing, Stalking und Kinderpornographie sowie im Zusammenhang mit Körperverletzung und Diffamierung von Personen missbraucht; hierbei geht es meist nicht um wirtschaftliche Aspekte (wie etwa bei der Industriespionage), sondern darum, Menschen Schaden zuzufügen. Aus dieser Perspektive kann Photographie auch als Waffe gesehen werden.

Rechtliche Aspekte

[Bearbeiten]Das Medienrecht ist eines der am durchwachsendsten, am stärksten von Gesetzesnovellen betroffenen und durch Rechtsprechung beeinflußten Rechtsmaterien überhaupt. Bei der Fülle von Spezialkonstellationen sei hier auf grundlegendste Aspekte eingegangen.

Zu aller erst muß sich eine Rechtsnorm in ihrem Anwendungsbereich befinden. Anwendung begründen können u. a.:

- Territorium (Festland, zuzüglich maximal 12 Seemeilen Seefläche)

- Flaggenprinzip (an Bord von Wasser- und Luft-fahrzeuge)

- Nationalität von Tat-subjekt oder -objekt

Dabei erfahren unterschiedliche Rechtsnormen je nach Rechtsgebiet aufgrund unterschiedlicher Prinzipien Anwendung.

Die Bundesrepublik Deutschland als Gesetzgeber

[Bearbeiten]Die bundesdeutsche Rechtsordnung differenziert zwischen Funktionen eines Photographen: Einem Pressephotographen oder Strafermittler werden im Sinne der verfassungsrechtlich garantierten Pressefreiheit bzw. zur Ausübung des verfassungsrechtlichen Auftrages, effektive Strafverfolgung zu betreiben, weitere Spielräume eingeräumt, als jedermann sonst zustehen. Die folgenden Ausführungen beziehen sich ausschließlich auf autonom handelnde Privatpersonen, da diesen in aller Regel keine Resourcen zur rechtlichen Betreuung zur Verfügung stehen.

Das deutsche Recht abstrahiert zwischen

- Anfertigen von Lichtbildern, und

- Verwerten von Lichtbildern.

Beide Tätigkeiten müssen für sich betrachtet werden.

Bundesdeutscher privatrechtlicher Interessenausgleich

[Bearbeiten]Das wichtigste Gesetz für privatrechtliche Interessen ist das Gesetz über Urheberrecht und verwandte Schutzrechte, abgekürzt UrhG. Zentraler Begriff des UrhG ist das Werk. Im Immaterialgüterrecht wird einem Werk ein nicht-greifbarer (immaterieller) ideeler Wert zugesprochen, der im Rahmen eines fiktiven Gerüstes von Konzepten durch Rechtsnormen geschützt wird, 1 UrhG. Ab wann etwas ein Werk konstituiert, kann bereits eine knifflige Frage sein. Grundsätzlich muß zumindest ein Hauch von Schöpfungshöhe erreicht werden, um einen Schutz durch die Rechtsordnung zu erfahren, 2 Ⅱ UrhG. Zudem ist eine konkrete Manifestation erforderlich (andernfalls sind wir im Patentrecht). Sobald jemand (voluntativ) ein Lichtbildwerk, 2 Ⅰ ₅ UrhG, herstellt, wird er automatisch dessen Urheber, 7 UrhG, dem ausschließlich bestimmte Rechte zustehen, 11 ff. UrhG.

Nur einem Urheber steht es zu, sein Werk zu verwerten, 15 Ⅰ, Ⅱ UrhG, wobei eine urheberrechtliche Verwertung wiederum rein ideeler Natur ist und keiner wirtschaftlichen Komponente voraussetzt. Für uns von besonderer Bedeutung sind folgende Verwertungsrechte:

- das Vervielfältigungsrecht, 16 UrhG, also das Herstellen (körperlicher) Kopien, sowie

- das Recht der öffentlichen Zugänglichmachung, 19a UrhG, welche vor allem über das Zurverfügungstellen über das internet erfolgt.

Es gibt noch andere Verwertungsrechte, und es kann auch Verwertungsformen geben, die der Gesetzesgeber noch nicht kannte, aber trotzdem urheberrechtlichen Schutz genießen.

Bei Ausübung von Verwertungsrechten können dem Urheber allerdings Rechte anderer entgegenstehen. Für den Photographen relevant sind die Urheberrechte an abgebildeten Werken, sowie das sogenannte Recht am eigenen Bilde normiert im Gesetz betreffend das Urheberrecht an Werken der bildenden Künste und der Photographie, abgekürzt KUG. Neben der Möglichkeit mit den Rechteinhabern Vereinbarungen zu treffen, gibt es Schrankenregelungen, die kraft Gesetzes in bestimmten Rahmen eine eigene unabhängige Verwertung ohne gesonderte Einwilligung (vorherige Zustimmung, 182 1 BGB) gestatten. Für ein- und dieselbe Photographie können mehrere Schrankenregelungen gleichzeitig parallel Anwendung finden, je nachdem, welcher Teil zur Disposition steht.

Bei den nachfolgend besprochenen Schrankenbestimmungen des UrhG ist zu beachten, daß 62 Ⅰ UrhG für Anwender dieser ein Änderungsverbot auferlegt. Das bedeutet für Photos, daß Änderungen, die nicht aufgrund technischer Besonderheiten, sondern allein aus künstlerischen Erwägungen vorgenommen werden, unzulässig sind, wie 62 Ⅲ UrhG klarstellt. Dazu gehören bereits Streckungen, Verzerrungen, Kolorierungen oder „sonstige Verfremdung[en] des Originals.“ Eine Verletzung des Änderungsverbotes kann Schadensersatzansprüche nach sich ziehen, der Gebrauch einer Schranke bleibt aber unberührt.

Panoramafreiheit in Deutschland

[Bearbeiten]Das Photographieren anderer Werke stellt eine urheberrechtlich relevante Vervielfältigung dar. Die Reproduktion könnte im zuge der sogenannten Panoramafreiheit, 59 UrhG, gestattet sein, sofern diese bestimmte Anforderungen genügt:

- Reproduktionsform

- Die Panoramafreiheit gilt u. a. nur bei Lichtbildern. Nur diese Wiedergabeform kann sich auf die Panoramafreiheit stützen.

- Publizität

- Das abgebildete Werk muß sich an einem öffentlichen Ort befinden. Öffentlich ist ein Ort, sofern dieser frei zugänglich ist und im Gemeingebrauch steht. Die Eigentumsverhältnisse sind dabei unbeachtlich. Entscheidend ist, daß der Werkszugang über eine irgendwie geartete (faktische) Zuwendung an die Öffentlichkeit erfolgt („Widmung“). Ein freier Zugang liegt definitv nicht vor, wenn Zugangskontrollen oder Barrieren überwunden werden müssen. Zu Zugangskontrollen zählen u. a. Türen oder Drehkreuze, die nur bestimmten Personengruppen oder z. B. Fahrkarteninhabern offen stehen. Barrieren sind alle aufrechtgehenden Menschen hindernde Hemmnisse, wie Zäune, Mauern oder NATO-Draht-Absperrungen. Durchbrüche in Barrieren, die lediglich Tiere zurückhalten sollen, dürfen natürlich genutzt werden. Es schadet nicht, wenn ein Ort lediglich eingeschränkt zugänglich ist, wie zum Beispiel Zoos, Friedhöfe, oder Parks, die nur von 8—18 Uhr geöffnet sind.

- Generalrezeption

- Das abgebildete Werk muß vom öffentlichen Grund aus dargestellt werden. Dabei dürfen die Aufnahmen nicht unter Zunahme besonderer Hilfsmittel, wie etwa Leitern, Modellflugzeuge, oder eines Doppeldeckerbusses, entstehen.

- lokale Permanenz

- Bei dem abgebildeten Werk muß es sich um eine bleibende Installation handeln. Relevant ist nicht, für wie lange ein Werk existiert, sondern, ob es sich bleibend an einer Stelle befinden soll. So ist zum Beispiel die Panoramafreiheit im Falle der im Jahre 2002 erfolgten Reichstagsverhüllung nicht anwendbar. Andererseits sind Schnee- und Sand-skulpturen oder Pflastermalereien mit eingeschlossen.

Bei Anwendung dieser Schrankenregelung ist das Quellenangabepflicht aus 63 Ⅰ 1 UrhG zu beachten, welcher Ausnahmen und Gegenausnahmen zur Seite stehen. Praktisch relevant für jedermann ist die Quellenangabepflicht für Photographien von Plastiken im öffentlichen Raum, wo ein kleines Informationsschild oder Gravuren auf den Erschaffer hinweisen. Graffiti beeinhalten zumeist selbst eine Signatur, sodaß hier die Quellenangabe automatisch erfolgt.

Unwesentliches Beiwerk in Deutschland

[Bearbeiten]Darüber hinaus ist die Reproduktion von unwesentlichem Beiwerk zulässig, 57 UrhG.

- Beiwerk

- Damit ein Werk Beiwerk ist, muß es im Kontext eines größeren (Haupt-)Werkes erscheinen. Beim isolierenden Beschneiden oder „Freistellen“ eines Werkes entfällt diese Eigenschaft, womit sich nicht mehr auf diese Schranke berufen werden kann.

- Unwesentlichkeit

- Von einer Unwesentlichkeit ist jedenfalls dann auszugehen, „wenn das Werk weggelassen oder ausgetauscht werden könnte, ohne dass dies dem durchschnittlichen Betrachter auffiele […] oder ohne dass die Gesamtwirkung des Hauptgegenstandes in irgendeiner Weise beeinflusst wird“.

Recht am eigenen Bilde in Deutschland

[Bearbeiten]In 22 1 KUG wird die Verbreitung und zur öffentlichen Schaustellung des eigenen Bildes unter Einwilligungsvorbehalt gestellt. Das bloße Photographieren ist damit erstmal nicht umfaßt.

Damit das Recht am eigenen Bilde tangiert ist, muß es mindestens eine weitere Person geben, die die abgebildete Person identifizieren kann. Dies muß nicht zwingend über das Gesicht erfolgen, sondern kann auch über ein oder mehreren individualisierenden Merkmalen, wie besonders ausgefallene Kleidung, Haarschnit, Hautfarbe, der Figur, oder anderen, geschehen. Der Kontext – wie, genutztes Vehikel, einer Örtlichkeit, die die abgebildete Person häufig aufsucht, oder einfach das Vorhandensein einer bestimmten anderen Person (z. B. Lebenspartner) – können hierbei behilflich sein.

Das Recht am eigenen Bilde ist kein Werk im Sinne des Urheberrechtes, somit erfahren die Schranken des Urheberrechts auch keine Anwendung. Anstattdessen befreit 23 Ⅰ KUG einen vom Einwilligungserfordernis, wobei 23 Ⅱ KUG diese auferleben lassen kann.

Mögliche Gründe, daß keine Einwilligung erforderlich sind, können sein:

- 23 Ⅰ ₁ KUG: „Bildnisse aus dem Bereiche der Zeitgeschichte“, also Pressephotographien

- 23 Ⅰ ₂ KUG: „Bilder, auf denen die Personen nur als Beiwerk neben einer Landschaft oder sonstigen Örtlichkeit erscheinen“: Man beachte, daß – anders als 57 UrhG – es keiner Unwesentlichkeit bedarf: Wer einen belebten Marktplatz photographieren möchte kann nicht einfach die Menschen weglassen.

- 23 Ⅰ ₃ KUG: „Bilder von Versammlungen, Aufzügen und ähnlichen Vorgängen, an denen die dargestellten Personen teilgenommen haben“; Dabei muß aus der Abbildung oder Präsentation hervorgehen, daß es sich um eine Versammlung (oder vergleichbarem) handelt. Einzelne Personen herausstellende Photos lassen dies nicht erkennen.

- 23 Ⅰ ₄ KUG: „Bildnisse, die nicht auf Bestellung angefertigt sind, sofern die Verbreitung oder Schaustellung einem höheren Interesse der Kunst“

Anmerkung: Unter Umständen kann – im Sinne des informationellen Selbstbestimmungsrechts, einer Ausprägung des allgemeinen Persönlichkeitsrechts, 2 Ⅰ, 1 Ⅰ GG – das bloße Photographieren einer Person, zumindest einen Schadensersatzanspruch begründen, 1004 analog, 823 Ⅰ | 6 BGB. Insbesondere, wenn eine Person offensichtlich privat sein möchte, gebietet schon das eigene Taktgefühl, daß hier eine Photographie nicht auf Gegenliebe stößt. Andererseits ist nicht jedes „Unbehagen“ gleich ein „Schaden“ im rechtlichen Sinne, den es ggf. zu ersetzen gilt. Es bedarf schon einer gewissen Eingriffsintensität.

Andere rechtliche Besonderheiten in Deutschland

[Bearbeiten]Der urheberrechtliche Schutz währt nicht ewig: Generell ist nach Ablauf des 70. Kalendarjahres nach dem Tod des Urhebers Schluß, 64 UrhG.

Bundesdeutscher Anfertigungsverbote

[Bearbeiten]Das bundesdeutsche Recht ist eines mit am Abstand liberalsten, wenn es um die bloße Anfertigung von Photographien geht. Grundsätzlich darf jeder alles photographieren. Es gibt jedoch bestimmte Ausnahmen, in denen der deutsche Gesetzgeber aufgrund der Form ein besonderes Gefahrenpotential vorhersieht (sogenannte Einschätzungsprärogative).

Im deutschen Strafgesetzbuch werden besondere Herstellungsverbote normiert. Für sie gilt, sofern nichts anderes bestimmt, daß sie Vorsatz bezüglich Begehung voraussetzen, 15 StGB. Vorsatz ist der Wille zur Verwirklichung eines gesetzlichen Tatbestandes in Kenntnis aller seiner objektiven Tatumstände. Dieser muß zum Zeitpunkt der Tatbegehung vorliegen.

Die Herstellung von kinderpornographischen Schriften (das schließt Photographien mit ein, 11 Ⅲ StGB) ist verboten, 184b Ⅰ ₃ StGB. Kinder im Sinne dieser Norm sind alle unter vierzehn Jahren, 184b Ⅰ ₁ a StGB. Dabei ist zu beachten, daß kinderpornografisch im Sinne dieser Norm nicht nur Darstellungen sind, wie sie etwa im Erwachsenenbereich als pornografisch anzusehen wären, sondern auch vermeintlich unschuldige Aufnahmen, wie „die sexuell aufreizende Wiedergabe […] des unbekleideten Gesäßes eines Kindes,“ 184 Ⅰ ₁ c StGB, oder generell „die Wiedergabe eines ganz oder teilweise unbekleideten Kindes in unnatürlich geschlechtsbetonter Körperhaltung“, 184 Ⅰ ₁ b StGB. Die Tat ist ein Unternehmensdelikt, 11 Ⅰ ₆ StGB, das heißt an sich bereits nach Tatentschluß – auch ohne Vollendung – strafbar.

Strafbewehrt ist gemäß 201a StGB die „Verletzung des höchstpersönlichen Lebensbereichs durch Bildaufnahmen“. Diese Norm wird umgangssprachlich auch als „Spannerschutz“ bezeichnet. Neben diesem Problem sei erwähnt, daß das Photographieren von Unfallopfern unerwünscht ist, 201a Ⅰ ₂ StGB.

Außerdem ist die Herstellung von Gewaltdarstellungen verboten, 131 StGB.

Bei allen Straftaten kann ein rechtfertigender Notstand (34 StGB) in betracht kommen, sofern ein absolut geschütztes Rechtsgut dadurch geschützt wird.

Man beachte, daß „Urheberrechtsverletzungen“ gemäß 106 folgende UrhG und die Verletzung des Rechts am eigenen Bilde gemäß 33 Ⅰ KUG strafbewehrt sind. Diese Straftaten werden nur auf Antrag verfolgt, 109 UrhG bzw. 33 KUG (bei Urheberrechtsverletzungen kann die Strafverfolgungsbehörde allerdings auch auf ein besonderes öffentliches Interesse erkennen). Antragsberechtigt sind die Rechteinhaber vom jeweils betroffenen Recht, 77 StGB [1 Ⅰ EGStGB].