Digitale bildgebende Verfahren: Lichtwandlung

Vorwort | Grundlagen | Beleuchtung | Bildaufnahme | Lichtwandlung | Digitale Bilder | Wiedergabe | Transformationen | Literatur

Dieses Kapitel beschäftigt sich mit elektrischen und elektronischen Verfahren, Teilchen – insbesondere Lichtteilchen (Photonen) – zu detektieren, um digitale Bilder zu erzeugen. Da Elementarteilchen oft mittelbar durch Sekundarteilchen nachgewiesen werden und diese Sekundarteilchen auch Lichtteilchen sein können, wird auch deren Detektion häufig photographisch vorgenommen, also wie die Übersetzung dieses Begriffes aus dem Griechischen besagt: es wird mit Licht geschrieben. Typischerweise sieht das Prinzip der Bildgebung durch Lichtwandlung wie folgt aus:

- Ein Objekt muss Strahlung aussenden, um aufgenommen werden zu können. Oft wird ein solches Objekt zu diesem Zweck von außen mit Strahlung angeregt.

- Die Strahlung wird detektiert, wobei häufig direkt oder indirekt Licht verwendet wird, da es zum Nachweisen durch Brechung und Reflektion gut beeinflusst werden kann (siehe auch Kapitel Bildaufnahme).

- Die im Detektor analog nachgewiesene Strahlung wird mittels einer Analog-Digital-Wandlung in ganzzahlige (also digitale) Werte gewandelt.

- Die digitalen Signale werden nach grundlegenden Prinzipien verarbeitet (zum Beispiel Korrekturen, Linearisierung, Koinzidenzen, Korrelation).

- Die verarbeiteten Daten werden als Rohdaten zwischengespeichert (es kann sich hierbei um einen flüchtigen Speicher handeln).

- Die Rohdaten werden zur Weiterverwendung einer Bildverarbeitung unterzogen (zum Beispiel Farbkorrektur, Kontrast- und Helligkeitsanpassung, Bildausschnitt (siehe auch Kapitel Digitale Bilder).

- Die aufbereiteten digitalen Bilddaten werden gespeichert (oft in einem nicht-flüchtigen Speicher, um sie zu dokumentieren und auch später jederzeit sichtbar machen zu können).

- Die Bilddaten können mit Hilfe einer Bildwiedergabe sichtbar gemacht werden (siehe auch Kapitel Wiedergabe).

Lichtdetektoren

[Bearbeiten]Photoeffekt

[Bearbeiten]

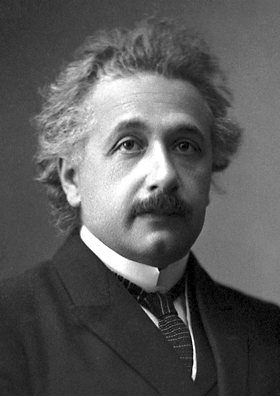

Als der Physiker Albert Einstein 1905 das Wesen des photoelektrischen Effektes entdeckte und beschrieb, wurde damit auch ein wesentlicher Grundstein für die elektronische Lichtdetektion gelegt. Völlig zurecht wurde er für diese Entdeckung für das Jahr 1921 mit dem Physik-Nobelpreis geehrt - es ist erwähnenswert, dass dies der einzige an ihn verliehene Nobelpreis blieb.

Beim äußeren photoelektrischen Effekt übertragen Photonen ihre Energie auf Elektronen, die dadurch aus einem Festkörper herausgelöst werden. Die Lichtquanten müssen hierbei mindestens soviel Energie haben, dass die Austrittsarbeit des jeweiligen Kathodenmaterials überwunden werden kann. Geeignete Materialien für Licht sind Alkalimetalle wie Kalium, Rubidium und Cäsium.

Beim inneren photoelektrischen Effekt übertragen Photonen ihre Energie auf Elektronen, die dadurch vom Valenzband in das Leitungsband gehoben werden. Dadurch erhöht sich die Leitfähigkeit des Festkörpers. Ebenso tritt eine elektrische Spannung an ihm auf. Diese Effekte werden für die Detektion von Strahlung benutzt. Die Lichtquanten müssen hierbei mindestens soviel Energie haben, dass die Bandlücke zwischen Valenzband und Leitungsband überwunden werden kann. Geeignete Materialien für Licht sind Halbleiter wie Silicium oder Germanium.

Es gibt also eine Grenzwellenlänge für die Photonen, oberhalb der keine Elektronen ausgelöst werden können, da die Photonenenergie in diesen Fällen nicht ausreicht.

Mit der Photonenfrequenz und dem Planckschen Wirkungsquantum ergibt sich die Energie eines Lichtteilchens zu:

Das Produkt aus der Wellenlänge und der Frequenz der Photonen respektive der Lichtwellen ist die Lichtgeschwindigkeit :

Beide Beziehungen ergeben zusammengefasst den Zusammenhang zwischen der Energie und der Wellenlänge eines Photons:

Da die Austrittsarbeit überwunden werden muss, damit beim äußeren Photoeffekt ein ausgelöstes Elektron den Festkörper verlassen kann, verbleibt dem freien Elektron die Energiedifferenz aus der Photonenenergie und der Austrittsarbeit als kinetische Energie. Daraus folgt die Bedingung , dafür dass das ausgelöste Elektron überhaupt den Festkörper verlassen kann. Beim äußeren Photoeffekt werden also Elektronen durch einzelne Lichtteilchen aus einem Festkörper (meist aus der Oberfläche von Metallen) herausgelöst und können dann in einem äußeren elektrischen Feld zu einer Anode beschleunigt und auf diese Weise als elektrischer Strom registriert werden.

Beim inneren Photoeffekt verringert sich der elektrische Widerstand eines vom Licht bestrahlten Halbleiters beziehungsweise die in einer Kapazität gespeicherte Ladungsmenge durch einen entsprechenden neutralisierenden Strom respektive Ladungstransport. Auch dieser Effekt kann für den Nachweis und die Messung von Licht verwendet werden.

Photomultiplier

[Bearbeiten]

Ein Photomultiplier nutzt an seiner Kathode den äußeren Photoeffekt zur Erzeugung von freien Elektronen, die durch ein elektrisches Feld auf die erste Dynode beschleunigt werden. Treffen diese Elektronen auf die Dynode erzeugen sie bei hinreichend hoher kinetischer Energie sogenannte Sekundärelektronen. Ein einziges primäres Elektron kann hierbei eine Vielzahl von Sekundärelektronen hervorrufen. Schaltet man nun mehrere solcher Dynoden mit entsprechenden Feldgradienten hintereinander, so werden auch die Sekundärelektronen auf die nächste Dynode beschleunigt und erzeugen dort wiederum neue Sekundärelektronen. Bei dieser kaskadierten Anordnung spricht man von einem Sekundärelektronenvervielfacher. An der letzten Elektrode der Kaskade, der Anode, steht dann ein relativ hoher Strom zur Verfügung, der mit einfachen Mitteln registriert werden kann. Dies führt sogar soweit, dass einzelne Photonen, die an der Kathode ein Elektron auslösen, zeitaufgelöst nachgewiesen werden können. Es ist allerdings nicht gewährleistet, dass ein auf die Kathode auftreffendes Photon tatsächlich immer ein Elektron auslöst, da die Quanteneffizienz in der Regel kleiner als eins ist.

Durch geeignete Maßnahmen ist bei der Beschaltung der Dynoden eines Photomultipliers zu gewährleisten, dass der Strom bei den letzten Dynoden nicht zu hoch wird, weil diese sonst durch das Elektronenbombardement thermisch zerstört werden können.

Mikrokanalplatten

[Bearbeiten]

Anstelle der diskreten Dynoden bei Photomultipliern können zur Sekundärelektronenvervielfachung auch Mikrokanäle aus einem Material verwendet werden, das eine gute Sekundärelektronenausbeute und einen relativ hohen elektrischen Widerstand hat. Beim Anlegen einer elektrischen Spannung an den beiden Enden der Mikrokanäle ergibt sich eine kontinuierliche Potentialverteilung innerhalb der einzelnen Kanäle, so dass Sekundärelektronen, die an einer beliebigen Stelle eines Mikrokanals emittiert werden, in Richtung Anode beschleunigt werden, und an einer beliebigen anderen Stelle des Mikrokanals vervielfachte Sekundärelektronen hervorrufen können.

Halbleiterdetektoren

[Bearbeiten]Halbleiter können in sehr weit gestreuten Anwendungsbereichen eingesetzt werden. Im Wesentlichen werden dotierte Halbleiterübergänge verwendet, deren Leitfähigkeit sich beim Eintreten von Teilchenstrahlung verändert. Die Veränderung der Leitfähigkeit kann entweder als Strom registriert werden, oder sie führt zum Entladen von integrierten Kondensatoren. Die entsprechenden Bauelemente sind zum Beispiel für sichtbares Licht Photodioden oder Phototransistoren. Bei den letztgenannten wird der verursachte Strom durch den Transistoreffekt verstärkt. Für andere Teilchenarten, wie Röntgenphotonen, Elektronen oder andere radioaktive Strahlung kann oft auch entsprechend ausgelegte Halbleiterdetektoren verwendet werden, wenn die Teilchenenergie nicht zu hoch ist.

Die Rotgrenze bei Silicium-Halbleitern liegt wegen der Bandkante der Energieniveaus von Silicium bei etwa 1100 Nanometern, also im nahen Infrarotbereich. Am kurzwelligen Ende des elektromagnetischen Spektrums nimmt die Quanteneffizienz von Silicium stark ab, so dass es in der Praxis nur bis etwa 300 Nanometer eingesetzt werden kann.

Szintillationsdetektoren

[Bearbeiten]Bei Szintillationsdetektoren stammt das registrierte Licht nicht unmittelbar vom zu messenden Signal, sondern primäre Teilchen mit hoher Geschwindigkeit, wie zum Beispiel Elementarteilchen, Atome oder Ionen, werden mit Hilfe von festen oder flüssigen Szintillatoren abgebremst und die kinetische Energie der Teilchen wird zu einem großen Teil in Licht umgewandelt. Dieses Licht kann dann mit geeigneten Lichtdetektoren aufgefangen und analysiert werden. Aus der Intensität und spektralen Verteilung des Lichtes können dann Rückschlüsse auf die Art und Energie der registrierten Teilchen gezogen werden.

Mit schnellen Szintillatoren kann eine gute Zeitauflösung erzielt werden, so dass auch bei sehr schnellen Teilchen Koinzidenzen ermittelt werden können.

Hodoskope

[Bearbeiten]

Beim Einsatz von mehreren Teilchendetektoren in Hodoskopen ist über Zeitpunkte der Szintillationsblitze die Bestimmung der Geschwindigkeit der Teilchen und sogar der geometrischen Bahn (Trajektorie) möglich.

Bei der Kombination zwei verschiedenartiger Szintillatoren, von denen einer die zu bestimmenden Teilchen nur geringfügig abbremst und einen kleinen Verlust der kinetischen Energie der Teilchen nachweisbar macht, und ein anderer die Teilchen vollständig abbremst und somit die gesamte verbleibende kinetische Energie bestimmbar macht, kann nicht nur die kinetische Energie sondern indirekt auch die Masse der Teilchen bestimmt werden. Zur Unterscheidung der beiden Signale können Szintillatoren mit verschiedener Szintillationsdauer oder verschiedenartigem Lichtspektrum verwendet werden.

Digitalisierung

[Bearbeiten]Analog-Digital-Wandler

[Bearbeiten]Digitale Bilder werden bei der Aufnahme in der Regel im Zusammenhang mit einer Analog-Digital-Wandlung (englisch: analog digital converter (ADC)) erzeugt. Als analoges Messsignal stehen in der Regel elektrische Größen zur Verfügung, also Spannungen oder Ströme. Letztere werden durch Strom-Spannungs-Wandler in Spannungen umgesetzt, so dass die meisten Analog-Digital-Wandler eine Spannung innerhalb eines bestimmten Spannungsbereiches als Digitalwert in eine ganze Zahl umwandeln, die dann gespeichert und einem zeitlichen oder räumlichen Raster zugeordnet werden kann.

Für zeitaufgelöste Signale werden Spannungsänderungen mit Pulsdetektoren erfasst, die den Zeitpunkt und gegebenenfalls auch die Höhe eines Spannungspulses oder die Stärke einer Spannungsänderung weitergeben.

Bei ortsaufgelösten Signalen werden die digitalisierten Zahlenwerte in der Regel einem entsprechenden linearen ein-, zwei- oder sogar dreidimensionalen Raster zugeordnet.

Die zu digitalisierenden Spannungen können mit vielfältigen Möglichkeiten erzeugt werden. Häufig wird der innere oder äußere photoelektrische Effekt verwendet, um direkt einen elektrischen Strom zu erzeugen oder indirekt die Ladungsmenge an den Elektroden von Kondensatoren und somit die der Ladungsmenge proportionale Elektrodenspannung zu verändern.

Der Digitalwert für den zu digitalisierenden Strom ist in erster Näherung oft proportional zur Leuchtdichte beziehungsweise zum Photonenstrom und zum Lichtstrom :

Der Digitalwert für die zu digitalisierende Spannung ist in erster Näherung oft proportional zu der in einer bestimmten Zeit gemessenen Photonenmenge :

Dunkelstrom

[Bearbeiten]Abweichungen bei der Proportionalität ergeben sich zum Beispiel durch nicht-lineare Kennlinien von Halbleitern und durch Dunkelströme. Letzterer erzeugt auch ohne Lichteinfall ein zufälliges und permanentes Signal, das ebenfalls digitalisiert wird und den minimal nachweisbaren elektrischen Strom respektive Lichtstrom und somit auch den dynamischen Umfang des Messbereiches begrenzt.

Der Dunkelstrom kann in Halbleitern durch Kühlung stark reduziert werden und verdoppelt sich in Halbleitern typischerweise bei einer Erwärmung um einige Kelvin jeweils. Dabei ist es unerheblich ob die Ursache für die Erwärmung extern ist (Wärmestrahlung) oder durch die Wärmeleistung bei der Umwandlung von elektrischer in thermische Energie beim Messprozess selber entsteht.

Bit-Tiefe

[Bearbeiten]Die Anzahl der nach der Digitalisierung zu unterscheidenden Spannungen ist durch die Bit-Tiefe der Daten gegeben, die wiederum den Wertebereich der ganzen Zahlen bestimmt. Oft wird die Bit-Tiefe in Mehrfachen der Zahl acht angegeben, da acht Bit traditionell zu einem Byte zusammengefasst werden. Es ist aber mit modernen Geräten zunehmend auch üblich, dass die Bits zu Datenworten von 16, 32, 48, 64 oder gar 128 Bit zusammengefasst werden. Diese Datenworte können weiterverarbeitet und gespeichert werden.

Die Anzahl der in einem Datenwort unterscheidbaren Werte ergibt sich wegen der Binärität (Basis = 2) der Bits aus der Bit-Tiefe zu:

Bei einer Bit-Tiefe von acht, wie zum Beispiel für einen Farbkanal von JPEG-Bilddateien, ergeben sich also 256 verschiedene Zustände die digital als die ganzen Zahlen von 0 bis 255 interpretiert werden und entsprechenden Signalhöhen zugeordnet werden können. Der Wert 0 steht hierbei in der Regel für das niedrigste darstellbare Signal (Dunkelwert), und der Wert 255 steht für das höchste darstellbare Signal (Hellwert). Für präzise Messungen sind höhere Bit-Tiefen, wie zum Beispiel 10, 12, 14 oder gar 16 Bit erforderlich.

| Bit-Tiefe |

Anzahl der diskreten Werte |

Wertebereich |

|---|---|---|

| 1 | 2 | 0..1 |

| 2 | 4 | 0..3 |

| 4 | 16 | 0..15 |

| 8 | 256 | 0..255 |

| 10 | 1024 | 0..1023 |

| 12 | 4096 | 0..4095 |

| 14 | 16384 | 0..16383 |

| 16 | 65536 | 0..65535 |

| 24 | 16777216 | 0..16777215 |

| 32 | 4294967296 | 0..4294967295 |

Siehe auch Abschnitt Bit-Tiefe

Meist wird der Dunkelwert 0 beim Fehlen oder Ausbleiben eines Bildsignals verwendet. Wird das Signal zu stark, können Werte oberhalb des Hellwertes nicht mehr unterschieden werden (Übersteuerung) und in der Regel wird dann der Hellwert gespeichert, wobei die Signalhöhe an dieser Schwelle abgeschnitten wird (englisch: Clipping).

Bildsensoren

[Bearbeiten]Bildsensoren bestehen heute oft aus ein- oder zweidimensional angeordneten Lichtdetektoren, die aus Halbleitern hergestellt werden. Die weiteste Verbreitung haben zweidimensionale Bildsensoren heute in digitalen Steh- und Bewegtbildkameras, sie werden zunehmend auch in mobile, multimediale Geräte, wie zum Beispiel Smartphones, Tablets oder Netbooks integriert.

Bildsensorempfindlichkeit

[Bearbeiten]Wesentlichen Unterschiede ergeben sich bei Bildsensoren durch die effektiv zur Verfügung stehende, lichtsammelnde Fläche in der Lichtempfindlichkeit (von englisch: speed). Dabei gilt:

Dies bedeutet, dass eine Vergrößerung der lichtsammelnden, effektiven Fläche in der Regel auch zu einer Vergrößerung der Lichtempfindlichkeit führt. Dies kann bei vorgegebener Bildsensorgröße durch die Verringerung der optisch passiven Stege zwischen den lichtempfindlichen Teilflächen der Bildsensoren, durch den Einsatz von Mikrolinsen-Arrays (siehe unten) oder auch einfach durch die Verringerung der Bildpunkte des Sensors erreicht werden.

Die Veränderung der Bildsensorgröße wirkt sich daher - wenn überhaupt - nur indirekt über das Verhältnis von optisch aktiven und optisch passiven Teilflächen auf die Gesamtlichtempfindlichkeit aus. Ferner muss beachtet werden, dass die lichtempfindlichen Teilflächen umso präziser und gleichmäßiger konstruiert werden können, je größer sie sind. Die Signalqualität und die Bit-Tiefe, die von einem Bildsensor mit vorgegebener Größe erreicht werden können, sind daher bei einer geringeren Anzahl von Bildpunkten und dafür größeren lichtempfindlichen Teilflächen in der Regel besser. Darauf bezogen ist es von Vorteil, wenn die Anzahl der Bildpunkte, die ein Bildsensor registriert, nicht höher ausfällt als unbedingt erforderlich. Häufig ergeben sich durch Beugungsbegrenzung oder durch Abbildungsfehler Randbedingungen, aus denen sich eine maximale sinnvolle Anzahl von Bildpunkten ergibt.

Eindimensionale Bildsensoren

[Bearbeiten]

Eindimensionale Bildsensoren, oder auch Zeilensensoren genannt, finden in Auflicht- und Durchlichtscannern weite Verbreitung.

Um zweidimensionale Bilder zu erhalten, können Zeilensensoren senkrecht zur Zeilenrichtung in einem Raster bewegt werden. Das zweidimensionale Bild kann dann aus den zu verschiedenen Zeitpunkten gewonnenen Zeilenbildern zusammengesetzt werden.

Bei bewegten abzubildenden Objekten kommt es dabei zwangsläufig zum Rolling-Shutter-Effekt. Dieser Effekt tritt auch auf, wenn ein zweidimensionaler Bildsensor eindimensional, also zeilen- oder spaltenweise, ausgelesen wird, während die Belichtung noch fortgesetzt wird.

Zweidimensionale Bildsensoren

[Bearbeiten]

Zweidimensionale Bildsensoren sind in der Regel rechteckig begrenzt und mit quadratischen Pixeln versehen. Das Bild einer optischen Abbildung ist jedoch meist kreisförmig, so dass der Bildsensor nur einen rechteckigen Ausschnitt des Bildkreises erfassen kann. Die folgenden Bildsensorgrößen digitaler Kamerasysteme haben größere Verbreitung gefunden (Stand 2016):

| Bildsensorklasse | Genutzte Bildsensordiagonale in Millimetern |

Digitales Kamerasystem |

|---|---|---|

| 1/2,3″ | 7,7 | Pentax Q |

| 1" | 15,9 | Nikon 1 (CX) |

| 4/3″ | 21,6 | Micro Four Thirds (Olympus, Panasonic, Kodak) |

| APS-C | ≈ 27,5 | Canon EF-M / EF-S, Fujifilm X, Leica T, Nikon F (DX), Pentax K, Samsung NX, Sony A / E |

| Kleinbildformat | 43,3 | Canon EF, Leica M / SL, Nikon F (FX), Sony A / E |

| Mittelformat | ≈ 60 | 645 (Mamija / Pentax), Fujifilm GFX, Hasselblad HCD, Leica S, Mamija ZD, PhaseOne XF |

Siehe auch:

- Abschnitt Normalbrennweite

- Abschnitt Bildauflösung

Bildseitenverhältnisse

[Bearbeiten]Digitale Spiegelreflexkameras haben aus traditionellen Gründen (Kleinbildfilmformat) oft Bildsensoren mit einem Bildseitenverhältnis von 3:2. Bildsensoren moderner digitaler Systemkameras haben häufig das von den ersten Computermonitoren und Fernsehgeräten her übliche Bildseitenformat 4:3. Für einfache Videoanwendungen (Standard Definition (SD) = standardauflösend) wurde daher meist auch das Format 4:3 verwendet, wohingegen moderne Videokameras (High Definition (HD) = hochauflösend) in der Regel Bildsensoren und Bildformate mit dem Bildseitenverhältnis 16:9 verwenden.

Durch Einstellung eines gewünschten Bildseitenverhältnisses können die Aufzeichnungsformate vieler Kameras leicht umgeschaltet werden. Die Aufnahme mit solchen Geräten macht jedoch nur Sinn, wenn ein elektronischer Sucher oder Kontrollmonitor den entsprechenden Ausschnitt zur Bildgestaltung anzeigt. Ein optischer Sucher zeigt das reele Bild einer matten Einstellscheibe oder ein virtuelles Bild mit einem festen Bildseitenverhältnis - hier kann man sich bestenfalls mit Strichmarken oder markierten Rahmen auf der Einstellscheibe behelfen, um abweichende Bildseitenverhältnisse deutlich zu machen.

Siehe auch Abschnitt Bildseitenverhältnis

Multi-Aspect-Bildsensoren

[Bearbeiten]Beim Grad der Ausnutzung der lichtempfindlichen Bildsensorfläche spielt das Bildseitenverhältnis eine Rolle. Meistens liegt die lichtempfindliche Fläche des Bildsensors vollständig im Bildkreis. so dass nur bei dem nativen Bildseitenverhältnis des Bildsensors die größe Bilddiagonale, maximal jedoch der Durchmesser des Bildkreises ausgeschöpft werden kann.

Wenn in Kauf genommen wird, dass einige Pixel in den Ecken des Bildsensors nie zur Bildgebung verwendet werden, gibt es eine Möglichkeit, bei einer Vielzahl von Bildseitenverhältnissen die gleiche Bilddiagonale innerhalb des Bildkreises auszunutzen. Die Geometrie des Bildsensors und die Größe des Bildkreises, namentlich die acht Schnittpunkte der Kanten des Bildsensors mit dem genutzen Bildkreis, ergeben dann das kleinste und größte Bildseitenverhältnis, bei dem die maximale Bilddiagonale berücksichtigt werden kann.

- Verschiedene Bildseitenverhältnisse auf einem Bildsensor mit Begrenzung durch den Bildkreis

-

Ohne Beschneidung des Bildkreises - alle Bildpunkte des Bildsensors werden benutzt

-

Optimierung durch Beschneidung des Bildkreises - einige Bildpunkte in den Ecken des Bildsensors werden nie benutzt

Temperaturverhalten

[Bearbeiten]Das Verhalten von Halbleitern ist in der Regel temperaturabhängig. Bei einer Erhöhung der Temperatur um sechs Kelvin ist ungefähr mit einer Verdopplung des Dunkelstroms zu rechnen. Bei 60° Celsius ist der Dunkelstrom unter dieser Voraussetzung also etwa 1000 Mal höher als bei 0° Celsius.

Für Aufnahmen mit einem möglichst großen Signal-Rausch-Abstand ist es daher sinnvoll oder sogar notwendig, den Halbleiter zu kühlen. Der Dunkelstrom kann mit entsprechendem Aufwand, zum Beispiel bei der Kühlung mit flüssigem Stickstoff (bei normalem Luftdruck also bei -196° Celsius), extrem reduziert werden.

Für die genaue Messung und Detektion von Infrarotstrahlung ist eine Kühlung des Halbleiters unerlässlich. Daher wird beispielsweise auch bei Satelliten, die zur Beobachtung im Infraroten ausgerüstet werden, wie das Herschel-Weltraumteleskop, eine entsprechende Kühlung eingesetzt.

Im Folgenden werden zur Verdeutlichung die Signale des Dunkelbildes eines hochwertigen Active-Pixel-Bildsensors mit CMOS-Technologie (Ausschnitt mit 256 mal 256 Bildpunkten) gezeigt:

- Um den Faktor 8 verstärkte Signale bei acht Sekunden Belichtungszeit

-

Bei einer Temperatur von 25° Celsius

-

Bei einer Temperatur von 60° Celsius

Je länger die Belichtungszeit ist, desto stärker trägt der Dunkelstrom zu Störsignalen bei:

- Um den Faktor 16 verstärkte Signale bei 25° Celsius

-

Bei einer Millisekunde Belichtungszeit

-

Bei acht Sekunden Belichtungszeit

Höhenstrahlung

[Bearbeiten]Höhenstrahlung und die dadurch ausgelöste Sekundärstrahlung besteht aus energiereichen Elementarteilchen, die auch mit den Halbleitern der Bildsensoren wechselwirken und diese schädigen können. Dies passiert auch, wenn die Geräte lediglich transportiert werden, ohne dass sie in Betrieb sind. Empfindliche und hochwertige Bildsensoren sollten daher so weit wie möglich vor dieser Höhenstrahlung geschützt werden. Dies ist insbesondere bei Flügen in der oberen Atmosphäre besonders wichtig, da die schädigende Strahlung hier erheblich höher ist als an der Erdoberfläche. Die Schädigung zeigt sich meist durch den Ausfall einzelner Bildpunkte, was bei hinreichend schwerer Schädigung dann als Pixelfehler bezeichnet wird.

Pixelfehler

[Bearbeiten]

Je kleiner und zahlreicher die Bildpunkte auf dem Bildsensor sind, desto geringer wird die Signalqualität der einzelnen Bildpunkte. Dies kann sogar dazu führen, dass einzelne Bildpunkte gar kein verwertbares Signal liefern. Um schwache oder ausbleibende Signale zu kompensieren, kann zum einen der Dunkelstrom gemessen werden, während der Bildsensor nicht belichtet wird. Zum anderen kann der Bildsensor zum Beispiel mit Hilfe einer Ulbricht-Kugel (englisch: Integrating Sphere) gleichmäßig beleuchtet werden, um die Unterschiede der Signalempfindlichkeit der verschiedenen Bildpunkte zu ermitteln. Das sich daraus ergebene Muster für die Verteilung der gestörten Bildpunkte ist für jeden Bildsensor einzigartig und somit eindeutig. Wenn das Muster bekannt ist, kann es also zu einem späteren Zeitpunkt zur Identifikation des Bildsensors verwendet werden.

Unmittelbar nach einer Aufnahme können der individuelle Dunkelstrom und die jeweilige Signalempfindlichkeit für jeden Bildpunkt rechnerisch berücksichtigt beziehungsweise fehlende Information mit Hilfe der funktionstüchtigen Nachbarpunkte interpoliert werden (zum Beispiel mit einem nachgeschalteten Field Programmable Gate Array (FPGA)), um eine scheinbare Homogenität zwischen benachbarten Bildpunkten zu erzeugen. Bei hohen Anforderungen an die reale (nicht berechnete) Homogenität der Bildpunkte muss demnach auf Bildsensoren mit möglichst großen und damit wenigen Pixeln zurückgegriffen werden.

Bei Bewegtbildaufnahmen sind Pixelfehler besonders störend, da die ortsfesten Defekte bei Schwenks, Zoomfahrten oder bei bewegten Objekten nicht nur leichter wahrnehmbar sind, sondern auch ziemlich auffällig sein können. Hier ist besonders sorgfältig darauf zu achten, dass die eingesetzten Bildsensoren nicht zu viele Bildpunkte und möglichst keine Pixelfehler haben.

Infrarot-Sperrfilter

[Bearbeiten]

- Erste doppelbrechende Schicht des Tiefpassfilters

- Infrarot-Sperrfilter mit zirkular polarisierender Dünnschicht (λ/4-Plättchen)

- Zweite doppelbrechende Schicht des Tiefpassfilters

Da die meisten Halbleiter auch im Infraroten noch eine relativ hohe Lichtempfindlichkeit aufweisen, trägt infrarotes Licht in großem Maße zur Belichtung der Bildsensoren bei. Dieser Effekt kann zwar beispielsweise bei Nachtsichtgeräten vorteilhaft eingesetzt werden, führt jedoch bei Aufnahmen mit sichtbarem Licht unter Umständen zu erheblichen Fehlbelichtungen oder Farbabweichungen. In diesen Fällen muss das infrarote Licht durch Infrarot-Sperrfilter absorbiert oder auch durch entsprechende Interferenzfilter reflektiert werden, so dass das unsichtbare Infrarotlicht nicht auf den Bildsensor gelangt.

Da die Absorption des infraroten Lichtes proportional zur Dicke der Infrarot-Sperrfilters ist, absorbieren diese umso besser, je dicker sie sind. Bei schräg einfallenden Strahlen wirken diese Sperrfilter dann jedoch wie eine Planplatte, die die Strahlen unter Umständen so stark parallel zum einfallenden Strahl versetzt, dass diese in benachbarten Bildpunkten registriert werden (siehe auch Abschnitt Ablenkung von Lichtstrahlen). Diese winkelabhängigen Aberrationen führen unter Umständen zu Kontrastverlusten und Unschärfen (siehe auch Abschnitt Modulationsübertragung) sowie geometrischen Fehlern in der optischen Abbildung (siehe auch Abschnitt Güte der optischen Abbildung). Um diese Fehler so gering wie möglich zu halten, werden bei entsprechenden Bildsensoren angepasste Objektive eingesetzt, die zum Beispiel bildseitig telezentrisch gerechnet sind. Bei solchen Objektiven sind die austretenden Strahlen weitgehend parallel zur optischen Achse, fallen somit mehr oder weniger senkrecht auf die optischen Filter und den Bildsensor ein und erfahren daher kaum einen seitlichen Versatz (siehe auch Abschnitt Telezentrie).

Oft sind die Infrarot-Sperrfilter im optischen Tiefpassfilter direkt vor dem Bildsensor integriert. Bei der Verwendung von Infrarot-Sperrfiltern in den Objektiven oder bei der Beleuchtung der abzubildenden Objekte kann auf eine weitere Infrarotlicht-Filterung am Bildsensor gegebenenfalls verzichtet werden.

Ultraviolett-Sperrfilter

[Bearbeiten]Auch im Ultravioletten weisen Bildsensoren eine gewisse Lichtempfindlichkeit auf. Da die in Objektiven verwendeten Glassorten üblicherweise jedoch eine geringe Transmission für ultraviolette Strahlung aufweisen, stellt dies häufig kein großes Problem dar. Unter Umständen kann es dennoch hilfreich sein, Ultraviolett-Sperrfilter einzusetzen, um Fehlbelichtungen beziehungsweise Fehlmessungen zu vermeiden.

Soll ultraviolette Strahlung jedoch nachgewiesen werden, ist der Einsatz von Glassorten erforderlich, die eine hohe Transmission für diese Strahlung aufweisen, wie zum Beispiel Quarzglas, das auch noch bei Lichtwellenlängen bis herunter zu 160 Nanometern eingesetzt werden kann.

Farbfilter-Arrays

[Bearbeiten]

Halbleiterdetektoren haben zwar eine bestimmte spektrale Empfindlichkeit, diese kann jedoch nicht unmittelbar herangezogen werden, um die spektrale Verteilung des registrierten Lichtes zu diskriminieren. Diese Detektoren sind also nur in der Lage, die Helligkeit eines Lichtsignals zu ermitteln.

Um Farbbilder zu generieren, müssen also zusätzliche Maßnahmen ergriffen werden. Dazu werden in der Regel Farbmosaiken verwendet, die so gestaltet sind, dass bei einem Bildsensor jeder Bildpunkt nur einen eingeschränkten spektralen Bereich empfangen kann. Oft werden die Primärfarben des menschlichen Auges rot, grün und blau (RGB) eingesetzt. Da das menschliche Auge im Grünen deutlich empfindlicher ist als im Roten und im Blauen, werden bei den Farbfilter-Arrays häufig doppelt so viele grüne Farbfilter eingesetzt wie rote oder blaue. Einige Hersteller verwenden auch zwei verschiedene Grüntöne in den Farbmosaiken (G = green = grün (Primärfarbe) und E = emerald = smaragdgrün).

Allgemein ist zu beachten, dass die farbempfindlichen Zäpfchen nicht nur wesentlich unempfindlicher sind als die helligkeitsempfindlichen Stäbchen, sondern dass erstere auf der Netzhaut auch erheblich dünner verteilt sind als letztere. Das menschliche Auge ist daher auch bei besten Sichtbedingungen noch nicht einmal in der Lage, eine Million farbige Punkte zu unterscheiden. Bei optimalen Bedingungen können im Sehzentrum jedoch bis zu vier Millionen verschieden helle Punkte unterschieden werden. Aus diesem Grund werden von einigen Herstellern Bildsensoren angeboten, bei denen nicht alle Bildpunkte mit Farbfiltern ausgestattet sind, sondern nur zur Ermittlung der Bildhelligkeit herangezogen werden.

Da die Elemente der Farbfilter-Arrays häufig aus Gelatine bestehen, in die die entsprechenden Farbpigmente oder Farbstoffe eingebettet worden sind, besteht bei Farbfilter-Arrays eine gewisse Anfälligkeit gegenüber Feuchtigkeit, die zur Instabilität bei der Farbfilterung führt. Für den Einsatz in feuchter Umgebung ist daher darauf zu achten, dass die Farbfilter-Arrays sehr gut gegen das Eindringen von Feuchtigkeit geschützt werden.

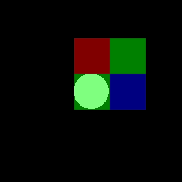

- Abbildung eines farblosen Schachbrettmusters (jeweils links) mit einem Bayer-Sensor mit Farbmosaik (jeweils Mitte)

-

Dadurch, dass nur die grünen "Dots" des Bayer-Sensors belichtet werden, sind in der Abbildung (rechts) nur schwarze und grüne Bildpunkte vorhanden

-

Dadurch, dass nur die roten und blauen "Dots" des Bayer-Sensors belichtet werden, sind in der Abbildung (rechts) nur schwarze, rote und blaue Bildpunkte vorhanden

Farbinterpolation

[Bearbeiten]Da typische Farbsensoren nur eine Farbe pro Bildpunkt (englisch: dot) erfassen, jedoch meist alle Farben in jedem Bildpunkt (englisch: pixel) ausgegeben werden, müssen die jeweils fehlenden Pixel-Farben rechnerisch aus den Nachbar-Dots interpoliert werden. Bei helligkeitsmodulierten Objekten (beispielsweise bei Abbildungen von Fischgräten- oder Schachbrettmustern) ergibt sich in den hellen Pixeln jeweils eine bestimmte gemessene Farbe, wohingegen die Nachbar-Dots nicht beleuchtet werden und daher dunkel erscheinen. Bei der Rekonstruktion dieser Bilder ergeben sich dann unter Umständen nur farbige Bildpunkte, obschon die abgebildete Vorlage keine Farbe enthielt. Dieser Effekt kommt durch die Verletzung des Abtasttheorems zustande und wird auch als Alias-Effekt (lateinisch alias = anders) oder im Englischen Aliasing bezeichnet, da die Farben und Helligkeiten anders wiedergegeben werden, als sie in der Vorlage vorhanden sind.

- Interpolation eines durch den Alias-Effekt verfälschten Bildes

-

Bei der Interpolation eines durch den Alias-Effekt verfälschten Bildes mit grünen "Dots" (links) werden die schwarzen Bildpunkte ebenfalls grün gerechnet (rechts)

-

Bei der Interpolation eines durch den Alias-Effekt verfälschten Bildes mit roten und blauen "Dots" (links) werden die schwarzen Bildpunkte auf die Mischfarben von rot und blau gerechnet (Magenta-Farbtöne, rechts)

Pixel-Shift

[Bearbeiten]Die fehlende Farbinformation bei einzelnen Bildpunkten innerhalb von Farbfilter-Arrays kann durch mehrere Aufnahmen kompensiert werden, die jeweils um einen Bildpunkt verschoben werden, so dass jeder Bildpunkt in jeder Primärfarbe des Farbfilter-Arrays abgetastet wird. Das Verfahren hat den Nachteil, dass das aufgenommene Objekt und das Kameragehäuse während des Verschiebevorgangs nicht bewegt werden dürfen, um Bewegungsartefakte zu vermeiden. Werden jedoch bewegliche Bildsensoren zur Bildstabilisierung eingesetzt, können gleichzeitig Bildstabisilierung und Pixel-Shift durchgeführt werden, so dass nur das aufgenommene Motiv unbeweglich sein muss, nicht jedoch das Kameragehäuse.

Im folgenden Beispiel soll ein leuchtender Kreis mit dem Durchmesser der Bildpunkte eines Bildsensors mit Bayer-Mosaik aufgenommen werden:

- Aufnahme eines weißen Kreises mit einem Bildsensor mit Farbmosaik-Filter

-

In der Bildebene ist ein weißer Kreis abgebildet.

-

Der Bildsensor tastet in der Bildebene jeden Bildpunkt mit vier Subpixeln mit jeweils einer der drei Primärfarben rot, grün oder blau ab.

Wird der Bildsenor bei vier aufeinanderfolgenden Aufnahmen um jeweils einen Bildpunkt zunächst nach rechts, dann nach oben und schließlich wieder nach links verschoben, dann tasten vier verschiedende Sensorelemente mit jeweils einer Primärfarbe den Bildpunkt ab. Anschließend können die vier Bilder zu einem einzigen Bild überlagert werden:

- Abtastung eines weißen Kreises mit in der Bildebene verschobenem Bildsensor mit Farbfilter-Array

-

Der weiße Kreis wird vom roten Sensorelement erfasst.

-

Der weiße Kreis wird nach dem Verschieben des Bildsensors nach links vom ersten grünen Sensorelement erfasst.

-

Der weiße Kreis wird nach dem Verschieben des Bildsensors nach oben vom blauen Sensorelement erfasst.

-

Der weiße Kreis wird nach dem Verschieben des Bildsensors nach rechts vom zweiten grünen Sensorelement erfasst.

-

Im aus den vier Einzelbildern zusammengesetzten Bild gibt es einen farbneutralen, quadratischen Bildpunkt

Ein nützlicher Nebeneffekt ist, dass bei sonst gleichen Bedingungen (insbesondere gleiche Belichtungszeit) durch die Registrierung von mehreren Aufnahmen insgesamt mehr Licht aufgefangen und ausgewertet wird. Dadurch kann der dynamische Umfang der Signale (günstigeres Signal-Rausch-Verhältnis) verbessert werden.

Mikrolinsen-Arrays

[Bearbeiten]

Ein mehr oder weniger großer Anteil des Lichtes einer Abbildung fällt bei Bildsensoren auf die passiven Zwischenräume der lichtempfindlichen Bildpunkte und geht für die Aufnahme somit verloren. Um möglichst viel Licht registrieren zu können, wird versucht, diese Zwischenräume so gering wie möglich zu gestalten. Ferner werden Mikrolinsen-Arrays eingesetzt, die pixelweise auch das Licht, das ungebrochen neben die lichtempfindlichen Pixel fallen würde, durch ihre Sammellinsenwirkung auf diese Pixel zu fokussieren.

Um geometrische Abbildungsfehler bei schräg einfallenden Lichtstrahlen zu minimieren, müssen die Mikrolinsen genau im Raster der Bildpunkte und so dicht wie möglich vor dem Bildsensor eingebaut werden.

Polarisationsfilter

[Bearbeiten]Mit einem Polarisationsfilter (kurz oft Polfilter genannt) können Lichtstrahlen, die mit bestimmter Polarisationsrichtung durch den Polarisationsfilter gehen, ausgeblendet werden. Normalerweise ist natürliches Licht unpolarisiert, so dass mit einem Polarisationsfilter immer die Hälfte des Lichts mit der gesperrten Polarisationsrichtung herausgefiltert wird.

Ist das Licht aus geeigneten künstlichen Lichtquellen bereits linear polarisiert, wie zum Beispiel von einem Laser oder von einer Flüssigkristallanzeige, oder wird von glatten nicht-metallischen Oberflächen wie Wasser oder Glas reflektiert, dann wird es mit einem linearen Polarisationsfilter entweder gar nicht gefiltert, wenn die Polarisationsrichtungen der Lichtwellen und des Polarisationsfilter übereinstimmen (Phasenwinkel 0°), oder es wird ausgeblendet, wenn die Polarisationsrichtungen der Lichtwellen und des Polarisationsfilters um einen Winkel von 90° verdreht sind. Durch das Drehen des Polarisationsfilters auf Winkel zwischen 0° und 90 ° können für das polarisierte Licht alle Transmissionsgrade von null bis eins eingestellt werden. Meist befindet sich der entsprechende Polarisationsfilter vor dem Objektiv, er kann aber auch in das Objektiv oder zwischen Objektiv und Bildsensor eingebaut werden.

Die folgenden Bilder zeigen als Motiv einen Stadtplan hinter einer Glasscheibe, an der das von einer Bahnhofsuhr und der Bahnhofsbeleuchtung schräg auftreffende Licht linear polarisiert reflektiert wird. Die beiden oberen Bilder sind auf die Bahnhofsuhr und die beiden unteren Bilder auf die Mitte des Stadtplanausschnitts hinter der Glasscheibe scharfgestellt. Bei den mit unpolarisiertem Licht photographierten Bildern (links) dominiert eine auf der Glasfläche reflektierte Bahnhofsuhr beziehungsweise Bahnhofslampe die Belichtung. Wird das von der Glasoberfläche reflektierte Licht durch einen um 90° zur Polarisationsrichtung des reflektierten Lichtes gedrehten in den Strahlengang gebrachten Polarisationsfilter ausgeblendet (rechts), wird die Sicht auf den Bereich hinter der Glasfläche frei, so dass der Stadtplan bei der korrekten Entfernungseinstellung gut erkennbar wird.

- Stadtplan in einem Schaukasten hinter einer Glasscheibe mit Reflexionen auf der Glasoberfläche

-

Fokussierung auf das Spiegelbild einer Bahnhofsuhr auf der Glasscheibe ohne Polarisationsfilter. Das Spiegelbild besteht aus polarisiertem Licht und ist hell und gut erkennbar.

-

Fokussierung auf das Spiegelbild der Bahnhofsuhr auf der Glasscheibe mit Polarisationsfilter bei gleicher Belichtung. Das Spiegelbild wurde durch den senkrecht zur Polarisationsrichtung des Lichts des Spiegelbilds gedrehten Polarisationsfilter fast ausgelöscht.

-

Fokussierung auf den Stadtplan hinter der Glasscheibe ohne Polarisationsfilter. Der unscharf abgebildete Reflex der Bahnhofsbeleuchtung von der Glasoberfläche besteht aus polarisiertem Licht und ist heller als der vergleichsweise dunkle Stadtplan, so dass dieser nicht erkennbar ist.

-

Fokussierung auf den Stadtplan hinter der Glasscheibe mit Polarisationsfilter bei stärkerer Belichtung. Der Reflex der Bahnhofsbeleuchtung wird durch den senkrecht zur Polarisationsrichtung des Lichts des Spiegelbilds gedrehten Polarisationsfilter ausgelöscht, so dass der Stadtplan kontrastreich und vollständig erkennbar ist.

Bei zirkular polarisiertem Licht dreht sich die Polarisationsrichtung permanent mit der Wellenlänge beziehungsweise mit der Schwingungsdauer der Welle, so dass die Winkelgeschwindigkeit konstant ist. Rechtsdrehendes Licht wird von einem linksdrehenden Polarisationsfilter herausgefiltert und umgekehrt.

Wenn linear und zirkular polarisiertes Licht überlagert werden, entsteht elliptisch polarisiertes Licht, bei dem sich die Polarisationsrichtung mit konstanter Winkelgeschwindigkeit dreht, wobei die Amplitude der Welle mit der Frequenz der Welle zwischen einem Minimum und einem Maximum schwankt.

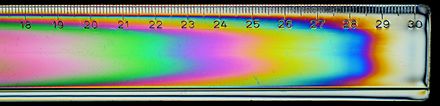

Bei durchsichtigen thermoplastischen Kunststoffen können beim Herstellungsprozess eingefrorene Materialspannungen zu einer Doppelbrechung des Materials führen, so dass dieses zirkular polarisierend wirkt. Werden solche Gegenstände in der Spannungsoptik mit polarisiertem Licht beleuchtet und mit einem Polarisationsfilter aufgenommen, können die Bereiche verschiedener Materialspannung farblich gut unterschieden werden, da die Lichtwellen mit unterschiedlicher Wellenlänge und Frequenz um verschiedene Winkel gedreht werden. Wird der Gegenstand mechanisch beansprucht, können sich die Spannungen im Material und somit auch das Farbmuster ändern.

Optische Tiefpässe

[Bearbeiten]

A:Von links fällt ein unpolarisierter Lichtstrahl ein.

B:Die erste doppelbrechende Schicht teilt den einfallenden unpolarisierten Strahl in einen ordentlichen und einen außerordentlichen Strahl auf.

C:Zwei linear polarisierte Teilstrahlen mit senkrecht aufeinanderstehenden Polarisationsrichtungen.

D:Eine Wellenplatte (λ/4-Plättchen) erzeugt aus linear polarisiertem Licht zirkular polarisiertes Licht.

E:Zwei zirkular polarisierte Teilstrahlen.

F:Die zweite doppelbrechende Schicht teilt die einfallenden zirkular polarisierten Strahlen in jeweils einen ordentlichen und einen außerordentlichen Strahl auf.

G:Vier linear polarisierte Teilstrahlen mit paarweise senkrecht aufeinanderstehenden Polarisationsrichtungen.

H:Auf einem Bildschirm ergeben sich vier in den Ecken eines Parallelogramms liegende Lichtflecke.

Der Alias-Effekt kann vermieden werden, wenn dafür gesorgt wird, dass Lichtstrahlen, die von einem Objektpunkt ausgehen und eine bestimmte Farbverteilung und Helligkeit haben, von mehreren Bildpunkten mit verschiedenen Farbfiltern gleichzeitig erfasst werden. Dazu werden in der Regel optische Tiefpassfilter verwendet, die aus stark brechendem und gleichzeitig doppelbrechendem Material wie zum Beispiel Lithiumniobat bestehen (anfangs wurden häufiger Quarzeinkristalle eingesetzt) und alle einfallenden Lichtstrahlen aufspalten und somit örtlich verteilen. Dazu werden meist zwei Filterplättchen um 90° gegeneinander verdreht kombiniert und durch ein dazwischenliegendes, zirkular oder elliptisch polarisierendes Medium (zum Beispiel ein λ/4-Plättchen) miteinander verbunden, so dass die beiden durch den ersten Tiefpassfilter aufgeteilten Strahlen erneut aufgespalten werden können. Die Lage der resultierenden vier Strahlen kann dann durch die Ecken eines Parallelogramms beschrieben werden. Bei zirkular polarisiertem Licht ergibt dabei sich ein Recheck, und wenn die beiden optischen Schichten der doppelbrechenden Materialien gleichartig und gleich dick sind ergibt sich ein Quadrat.

Wenn das zirkular oder elliptisch polarisierende Medium zwischen den doppelbrechenden Platten aus elektrisch beeinflussbaren Flüssigkristallen besteht, die in der Regel ebenfalls doppelbrechend sind, kann die Wirkung des Tiefpasses durch das Anlegen von geeigneten Steuerspannungen beeinflusst oder sogar aufgehoben werden.

Die hohen Ortsfrequenzen des Bildes werden durch den Tiefpass gedämpft und die Kanten zwischen hellen und dunklen Bildpartien werden weicher gezeichnet und breiter. Dadurch wird ein Objektpunkt immer von mehreren Bildsensorpunkten mit verschiedenen Farbfiltern erfasst. Dieses Verhalten kann bei Verzicht auf einen optischen Tiefpassfilter nicht informationstechnisch nachgebildet werden: in den digitalisierten Bilddaten und bei Beibehaltung der Anzahl der Bildpunkte (englisch: dots) als Bildpunkte (englisch: pixel) kann dies kein Signalprozessor und keine Firm- oder Anwendungssoftware leisten, da die erforderliche Information über die tatsächlichen Farben in keinem Bildpunkt vorliegt. Ohne optischen Tiefpassfilter kommt es durch den Alias-Effekt bei feinen Strukturen unweigerlich zu Farbfehlern bei der Interpolation (siehe auch Abschnitt Farbinterpolation).

Genauso wie bei Infrarot-Sperrfiltern ergibt sich auch bei optischen Tiefpässen das Problem einer winkelabhängigen Aberration (siehe auch Abschnitt Infrarot-Sperrfilter). Dieser Abbildungsfehler kann durch die Verwendung von telezentrischen Objektiven gemildert werden. Senkrecht auftreffende Lichtstrahlen werden allerdings nicht nur aberrationsfrei durch die optischen Schichten gelassen, sondern es erfolgt auch keine Aufspaltung der Lichtstrahlen durch die Doppelbrechung, da senkrecht zur Oberfläche eintretende Lichtstrahlen nicht gebrochen werden.

Bei Bildsensoren mit ausreichend hoher Anzahl von Sensorpunkten können ohne großen Aufwand mehrere benachbarte und verschiedenfarbige Sensorpunkte rechnerisch zu jeweils einem Bildpunkt zusammengefasst werden, ohne dass notwendigerweise optische Tiefpässe eingesetzt werden müssen. Ohne die Verwendung von optischen Tiefpässen kann es jedoch bei Strukturen, die im Bereich der maximalen Ortsfrequenz der Bildsensoren aufgenommen werden auch hierbei zu Alias-Effekten kommen. Alternativ kann die abbildende Optik (zum Beispiel durch Defokussierung, hinreichend große Aberration (Zerstreuungskreise) oder durch Beugungsbegrenzung (Beugungsscheibchen)) so gestaltet werden, dass die Kontrastübertragung von derartig kleinen Strukturen so gering ausfällt, dass diese vom Bildsensor praktisch nicht erfasst werden können. In diesem Fall kann auf die Verwendung von optischen Tiefpässen ohne weiteres verzichtet werden.

Bildsensorsysteme

[Bearbeiten]

Das Problem mit helligkeitsempfindlichen Bildsensoren auch Farbbilder aufnehmen zu können, kann auch gelöst werden, indem für verschiedene Grundfarben einzelne Bildsensoren mit entsprechenden einfarbigen Farbfiltern eingesetzt werden. Dazu werden in der Regel Strahlteiler mit farbselektiven Interferenzfilterschichten eingesetzt, und es muss gewährleistet sein, dass alle beteiligten Bildsensoren exakt denselben Bildausschnitt erfassen, was bei entsprechend hohen Bildpunktzahlen sehr schwierig wird, da die Übereinstimmung in Bezug auf die Verschiebung in den drei Raumrichtungen, sowie auf die Verdrehung und Verkippung zur optischen Achse gewährleistet werden muss. Bei photographischen Aufnahmen mit der Blendenzahl 2,0 muss diese Übereinstimmung beispielsweise in der Größenordnung von wenigen Mikrometern korrekt und stabil sein, um die drei Bilder weniger als einen Beugungsscheibchendurchmesser divergieren zu lassen.

So kann dies für Videoaufnahmen mit bis zu zwei Millionen Bildpunkten - wie zum Beispiel in digitalen Camcordern - durchaus realisiert werden, bei Stehbildaufnahmen mit einem Vielfachen dieser Bildpunktzahl sind die Präzision der Justage sowie die thermische und mechanische Stabilität der Aufnahmesysteme nicht ohne weiteres ausreichend.

Nichtsdestoweniger entfällt bei diesen Systemen das Erfordernis von Tiefpassfiltern zur Vermeidung von Alias-Effekten, da in jedem Bildpunkt tatsächlich alle Grundfarben erfasst werden und bereits im Rohdatenbild ohne Interpolationsberechnungen zur Verfügung stehen. Die verwendeten und erforderlichen Strahlteiler können aus Glasprismen hergestellt werden, die gleichzeitig als Infrarot-Sperrfilter ausgelegt sind. Ferner ist bei Bildsensoren mit geringerer Bildpunktzahl auch die Anzahl der Pixeldefekte geringer, und die Qualität der einzelnen Bildpunkte ist in Hinsicht auf das Dunkelstromrauschen und den Dynamikumfang meist besser.

Auf der anderen Seite sind der Konstruktionsaufwand und die Herstellungskosten höher als bei Ein-Sensorsystemen. Darüberhinaus ist zu beachten, dass die Schnittweite auf der optischen Achse bei der Verwendung von Prismenstrahlteilern etwas verlängert wird, und daher und auch wegen der zusätzlich erforderlichen Bauteile der Platzbedarf für das gesamte Aufnahmesystem erhöht ist.

CMOS

[Bearbeiten]CCD-Sensoren werden zunehmend von CMOS-Sensoren (Active Pixel Sensor) abgelöst, da diese eine wesentlich geringere Leistungsaufnahme haben und sich im Dauerbetrieb daher auch nicht so schnell und so stark erwärmen (siehe auch Abschnitt Temperaturverhalten). Ferner können diese Bildsensoren schneller und flexibler ausgelesen werden, was sich zum Beispiel positiv auf die Möglichkeiten der Belichtungsmessung, der Kontrastermittlung zu automatischen oder manuellen Scharfstellung (Autofokus oder Softwarelupe) in einzelnen Bildbereichen oder der Objekterkennung auswirkt.

Im Gegensatz zu CCD-Sensoren sind CMOS-Sensoren im Infraroten oft sehr lichtempfindlich. Bei Aufnahmen mit sichtbarem Licht sind entsprechende Infrarot-Sperrfilter unerlässlich, um Fehlbelichtungen, aber auch Farb- und Helligkeitsverfälschungen durch unsichtbares Licht zu vermeiden.

Der geringe Flächenanteil der lichtempfindlichen Elemente an der Oberfläche des CMOS-Sensors kann durch die Verwendung von Mikrolinsen-Arrays (siehe oben) kompensiert werden.

Inhomogenitäten zwischen benachbarten Bildpunkten können bei CMOS-Sensoren vermehrt zu Farbrauschen führen (siehe auch Abschnitt Farbrauschen).

Quantenfilm

[Bearbeiten]Quantenfilme bestehen aus einer Vielzahl von sehr kleinen lichtempfindlichen Quantenpunkten, die typischerweise einen Durchmesser von einem bis zu zehn Nanometern haben. Solche Quantenpunkte können sich durch eine recht hohe Quanteneffizienz und Speicherdichte auszeichnen, so dass bei der Bildaufnahme eine hohe Lichtempfindlichkeit und ein großer dynamischen Signalumfang zur Verfügung stehen. Die verschiedenen Bereiche mit mehreren in der vergleichsweise dünnen lichtempfindlichen Schicht aneinandergrenzenden Quantenpunkten können durch rechteckmatrixartig angeordnete Elektroden angesteuert und ausgelesen werden. Durch das Zusammenschalten von benachbarten Elektrodenspalten oder -zeilen können die ausgelesenen Bildpunkte vergrößert und in ihrer Form variiert werden. Durch geeignete Ansteuerung können alle Bildpunkte gleichzeitig und sehr schnell ausgelesen werden, zum Beispiel um einen Rolling-Shutter-Effekt zu vermeiden ("global shutter") oder um auf einen mechanischen Verschluss verzichten zu können.

Organische Bildsensoren

[Bearbeiten]Alternativ zu Quantenpunkten können auch lichtempfindliche organische Materialien eingesetzt werden, die ihre Leitfähigkeit aufgrund des inneren Photoeffekts verändern. Auch hier ist die Dicke der lichtempfindlichen Schicht sehr gering, und sie liegt in der Größenordnung der zu registrierenden Lichtwellenlänge. Die Ansteuerung der lichtempfindlichen Bereiche kann ähnlich wie beim Quantenfilm erfolgen, und der dynamische Signalumfang soll ebenfalls vergleichsweise hoch sein.

Vorwort | Grundlagen | Beleuchtung | Bildaufnahme | Lichtwandlung | Digitale Bilder | Wiedergabe | Transformationen | Literatur